Tag: CDNA 3

AMD今年或帶來Instinct MI350系列:升級至4nm工藝,採用HBM3E

前一段時間,美國政府修訂了最新的管制條例,針對人工智慧(AI)和高性能計算(HPC)為主要用途的晶片,4月4日開始實施的APP禁令進一步加強管控的力度,採取了更為嚴格的控制措施。

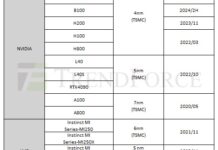

出口管制的型號不僅有英偉達和AMD之前大量的數據中心產品,比如NVIDIA A100/H100/A800/H800/L40/L40S/RTX 4090和AMD Instinct MI250/300系列,還包括NVIDIA H200/B100/B200/GB200和AMD Instinct MI350系列等下一代產品。

據TrendForce報導,Instinct MI350系列是AMD計劃在今年下半年推出的產品,屬於Instinct MI300系列的升級版本。其採用了台積電(TSMC)的4nm工藝製造,以提供更強的性能並降低功耗,同時搭配的顯存也由HBM3變成了HBM3E,速度提升了50%。據推測,AMD可能會採用12層堆疊的HBM3E,提高帶寬的同時加大容量。

在2023年12月6日主題為「Advancing AI」的活動中,AMD發布了Instinct MI300系列,首批提供了兩款產品,分別是Instinct MI300A(CPU+GPU)和Instinct MI300X(純GPU)。從過去這段時間來看,Instinct MI300系列的銷售相當不錯,AMD執行長蘇姿豐博士表示,2024年AMD的AI晶片銷售額預計將達到35億美元,高於之前20億美元的預期。

早在一個多月以前,就有報導稱,AMD將更新Instinct MI300系列,加入HBM3E。雖然Instinct MI350系列改用了價格更高的HBM3E,但是仍比英偉達產品的定價要更低,成本上依然有優勢。 ...

微軟是AMD Instinct MI300X的最大買家,定價或僅為H100的四分之一

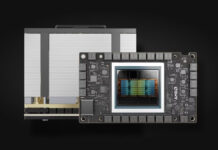

AMD在2023年12月6日舉辦了主題為「Advancing AI」的活動,推出了新一代針對數據中心的Instinct MI300系列計算卡。其中Instinct MI300X為純GPU設計,採用了CDNA 3架構,可為HPC和AI工作負載提供突破性的性能。

據Seeking Alpha報導,根據花旗集團的分析報告,顯示微軟的數據中心部門是Instinct MI300X的最大買家,已開始為GPT-4這類大型語言模型(LLM)工作。此前AMD執行長蘇姿豐博士表示,AMD在2024年AI晶片的銷售額預計將達到35億美元,高於之前20億美元的預期。

雖然AMD沒有公開Instinct MI300X的定價,不過有知情人士透露,每塊計算卡的售價為1.5萬美元,相比於英偉達的產品是比較實惠的。目前H100 PCIe 80GB HBM2E版本在市場上的售價大概為3萬美元到4萬美元,甚至更高一些,而性能更強的H100 SXM5 80GB HBM3版本的定價則更高。花旗集團的分析師表示,Instinct MI300X的定價或僅為後者的四分之一。此前AMD執行長蘇姿豐博士表示,AMD在2024年AI晶片的銷售額預計將達到35億美元,高於之前20億美元的預期。

Instinct MI300X採用了小晶片設計,混用5nm和6nm工藝,電晶體數量達到了1530億個。其使用了第四代Infinity Fabric解決方案,共有28個模塊晶片,其中包括8個HBM和4個計算晶片,而每個計算晶片擁有2個基於CDNA 3架構的GCD,共80個計算單元,意味著有320個計算單元和20480個流處理器。出於良品率的考慮,AMD削減了部分計算單元,實際使用數量為304個計算單元和19456個流處理器。此外,HBM3容量達到192GB,提供了5.3TB/s的內存帶寬和896GB/s的Infinity Fabric帶寬。 ...

Instinct MI300X成功引起市場關注,AMD新產品讓競爭對手「頭疼」

AMD在2023年12月6日舉辦了主題為「Advancing AI」的活動,推出了新一代針對數據中心的Instinct MI300系列計算卡。首批提供了兩款產品,分別是Instinct MI300A(CPU+GPU)和Instinct MI300X(純GPU),結合了最新的CDNA 3架構和Zen 4架構,可為HPC和AI工作負載提供突破性的性能。

近日有AMD的客戶確認,已經收到了Instinct MI300X,並開始為企業運行大型語言模型(LLM),進行相關的驗證工作。據Wccftech報導,AMD這次的新款GPU成功引起了市場的關注,在計算加速卡領域似乎要強勢回歸,競爭對手的客戶里,不少都對Instinct MI300X產生了興趣。

Instinct MI300X巨大的性能提升是一方面,另外AMD選擇的新品發布時間十分完美,恰逢英偉達被海量積壓訂單困擾,阻礙了新客戶的增長,也給了AMD更多的機會。人工智慧市場預計在未來幾年內迅速增長,市場規模到2027年將增至4000億美元,AMD執行長蘇姿豐將其歸為科技行業下一個大事件,正在為這一巨大增長做好准備。

Instinct MI300X採用了小晶片設計,混用5nm和6nm工藝,電晶體數量達到了1530億個。其使用了第四代Infinity Fabric解決方案,共有28個模塊晶片,其中包括8個HBM和4個計算晶片,而每個計算晶片擁有2個基於CDNA 3架構的GCD,共80個計算單元,也就是320個計算單元和20480個流處理器。出於良品率的考慮,AMD削減了部分計算單元,實際使用數量為304個計算單元和19456個流處理器。此外,HBM3容量達到192GB,提供了5.3TB/s的內存帶寬和896GB/s的Infinity Fabric帶寬。 ...

英偉達數據中心GPU最強競爭對手出貨,AMD客戶接收首批Instinct MI300X

近日LaminiAI執行長Sharon Zhou表示,AMD已經出貨用於人工智慧(AI)和高性能計算(HPC)的Instinct MI300X計算卡。據了解,LaminiAI得到了多台裝載Instinct MI300X的機器,每台配有8塊Instinct MI300X計算卡。這意味著,Instinct MI300X開始為企業運行大型語言模型(LLM)。

AMD開始出貨Instinct MI300系列已經有一段時間了,預計新產品可能成為其歷史上銷售最快的產品,目前已達到10億美元。對於AMD來說,這是一個重要的里程碑,將向英偉達主導的人工智慧晶片領域發起挑戰。首批Instinct MI300系列提供了兩款產品,分別是Instinct MI300A(CPU+GPU)和Instinct MI300X(純GPU)。

Instinct MI300X採用了小晶片設計,混用5nm和6nm工藝,電晶體數量達到了1530億個。其使用了第四代Infinity Fabric解決方案,共有28個模塊晶片,其中包括8個HBM和4個計算晶片,而每個計算晶片擁有2個基於CDNA 3架構的GCD,共80個計算單元,意味著有320個計算單元和20480個流處理器。出於良品率的考慮,AMD削減了部分計算單元,實際使用數量為304個計算單元和19456個流處理器。此外,HBM3容量達到192GB,提供了5.3TB/s的內存帶寬和896GB/s的Infinity Fabric帶寬。Instinct MI300A則是一款APU設計。其擁有24個基於Zen 4架構的內核,另外減少了1個計算晶片,使得計算單元數量也減至228個,對應14592個流處理器。

目前已經有不少大型雲端伺服器運營商采購Instinct MI300系列產品,有消息稱,今年預計出貨量為30萬至40萬,其中最大的客戶是谷歌和微軟,不過LaminiAI是首家確認已在使用Instinct MI300X計算卡的公司。 ...

AMD Instinct MI300A收獲新訂單:德國「Hunter」和「Herder」超算系統

AMD在2023年12月6日舉辦了主題為「Advancing AI」的活動,推出了新一代針對數據中心的Instinct MI300系列計算卡。首批提供了兩款產品,分別是Instinct MI300A(CPU+GPU)和Instinct MI300X(純GPU),結合了最新的CDNA 3架構和Zen 4架構,可為HPC和AI工作負載提供突破性的性能。

近日德國斯圖加特高性能計算中心(HLRS)發出公告,表示已經與HPE達成協議,基於Instinct MI300A打造兩台新的超級計算機,分別名為「Hunter」和「Herder」,將極大地擴展德國的高性能計算(HPC)能力。在第一階段,「Hunter」作為過渡超算系統在2025年開始運行,到了2027年的第二階段,再安裝「Herder」,這是一台擁有每秒百億億級(ExaFLOP)運算能力的超算系統。

官方表示,「Hunter」和「Herder」將為研究人員提供世界一流的仿真、人工智慧(AI)和高性能數據分析(HPDA)基礎設施,為計算工程和應用科學領域的前沿學術和工業研究提供動力。據了解,整個項目將耗資1.15億歐元。

Instinct MI300A是一款APU,採用了小晶片設計,混用5nm和6nm工藝製造,使用了第四代Infinity Fabric解決方案。其擁有24個基於Zen 4架構的內核,3個計算晶片,每個計算晶片擁有2個基於CDNA 3架構的GCD,計算單元數量為228個,對應14592個流處理器,配有128GB的HBM3,提供了5.3TB/s的內存帶寬。 ...

AMD推出Instinct MI300系列計算卡,提供數據中心AI解決方案組合

AMD在太平洋標准時間2023年12月6日早上10點(12月7日凌晨2點)舉辦了主題為「Advancing AI」的活動,推出了新一代針對數據中心的Instinct MI300系列計算卡。AMD表示,新產品具有業界領先的生成式AI內存帶寬,在大型語言模型(LLM)訓練和推理方面具有領先性能,結合了最新的CDNA 3架構和Zen 4架構,可為HPC和AI工作負載提供突破性的性能。

首批Instinct MI300系列提供了兩款產品,分別是Instinct MI300A(CPU+GPU)和Instinct MI300X(純GPU)。

Instinct MI300X採用了小晶片設計,混用5nm和6nm工藝,電晶體數量達到了1530億個。其使用了第四代Infinity Fabric解決方案,共有28個模塊晶片,其中包括8個HBM和4個計算晶片,而每個計算晶片擁有2個基於CDNA 3架構的GCD,共80個計算單元,意味著有320個計算單元和20480個流處理器。出於良品率的考慮,AMD削減了部分計算單元,實際使用數量為304個計算單元和19456個流處理器。此外,HBM3容量達到192GB,提供了5.3TB/s的內存帶寬和896GB/s的Infinity Fabric帶寬。

在此次大會上,AMD還宣布Instinct MI300A已進入量產階段,這是一款APU設計。其擁有24個基於Zen 4架構的內核,另外減少了1個計算晶片,使得計算單元數量也減至228個,對應14592個流處理器。

有消息稱,預計明年Instinct MI300系列的出貨量為30萬至40萬,其中最大的客戶是谷歌和微軟。 ...

傳三星與AMD達成協議,將為Instinct MI300系列提供HBM3和封裝技術

此前有報導稱,由於A100和H100數據中心GPU的需求大幅度提高,而負責製造及封裝的台積電(TSMC)產能有限,英偉達與三星進行談判,或許要分擔部分的工作量。三星的目標不僅僅是封裝訂單,還想借機拿下部分HBM3訂單,而之前都是SK海力士負責的。AMD新一代Instinct MI300系列產品也即將發貨,同樣需要HBM3和2.5D封裝,這意味著產能方面會更加緊張。

據Hangyunk報導,AMD已經與三星達成協議,後者將負責為Instinct MI300系列提供HBM3和封裝技術。鑒於台積電的封裝產能被英偉達大批量訂單占據,這讓AMD新產品陷入非常不利的局面,如果想進一步開拓人工智慧市場,急需其他合作夥伴分擔工作量,這也給了三星切入的機會。

目前三星已通過了HBM3的決定性質量測試,為與AMD之間的合作打下了基礎。隨著拿下AMD Instinct MI300系列產品的訂單,有機構預計明年三星將獲得HBM市場50%的份額。三星也向英偉達提出了新的方案,而現階段「雙源」戰略對後者可能更為有利,可以最大限度地提高產能,不過英偉達還需要顧及與台積電之間的關系。

根據現有的資料,Instinct MI300系列產品可能包括:

Instinct MI300A(CPU+GPU)- 6個XCD(最多228個CU / CDNA 3架構),3個CCD(最多24個核心 / Zen 4架構),8個HBM3堆棧(共128GB)

Instinct MI300X(純GPU)- 8個XCD(最多304個CU / CDNA 3架構),0個CCD(最多0個核心 / Zen 4架構),8個HBM3堆棧(共192GB)

Instinct MI300C(純CPU)- 0個XCD(最多0個CU...

AMD Instinct MI300系列分為三種版本,純CPU型號在Linux補丁出現

AMD新一代Instinct MI300系列計算加速卡即將上市,在之前的官方介紹中可以了解到,至少有兩款產品可以選擇,分別是Instinct MI300A(CPU+GPU)和Instinct MI300X(純GPU)。

據Coelacanth Dream報導,近期曝光的Linux補丁中還出現了名為「Instinct MI300C」的新款產品。據了解,這是Instinct MI300系列裡的純CPU版本,相當於搭配了HBM3的EPYC Genoa處理器,配備了96個Zen 4架構核心及128GB的HBM3。由於AMD還沒有公開這款產品,暫時還不清楚其定位,競爭對手應該是英特爾代號Sapphire Rapids-HBM的Xeon Max,其中包含了64GB的HBM2e。

根據現有的資料,Instinct MI300系列產品可能包括:

Instinct MI300A(CPU+GPU)- 6個XCD(最多228個CU / CDNA 3架構),3個CCD(最多24個核心 / Zen 4架構),8個HBM3堆棧(共128GB)

Instinct MI300X(純GPU)- 8個XCD(最多304個CU / CDNA...

AMD執行長稱未來10年AI將呈指數級增長,3到5年內市場規模達到1500億美元

近日,AMD執行長蘇姿豐博士正在台灣與主要行業領導者討論下一代晶片和新興的人工智慧(AI)市場計劃,期間再次強調了人工智慧帶來的巨大增長機遇,這股浪潮已經席捲了世界。

在接受相關媒體采訪時,蘇姿豐博士預計未來10年人工智慧將呈指數級增長,3到5年內相關產品的市場規模可能會達到1500億美元,而AMD已經將人工智慧作為分配資源和投資的首要領域。

業界認為蘇姿豐博士在此次訪問期間可能會與台積電(TSMC)就3nm晶片的生產達成協議,用於下一代晶片上,同時會為基於CDNA 3架構的Instinct MI300/MI300X安排產能,這是AMD在人工智慧市場的優先戰略之一。蘇姿豐博士強調,製造Instinct MI300/MI300X晶片是一個艱難的過程,需要與各種供應鏈合作夥伴合作,這也是此次訪問形成的議題之一。

蘇姿豐博士表示,人工智慧的增長不會很快停止,未來5到10年將看到重大發展,而AMD將來所有產品都將內置人工智慧技術,尤其是GPU,因為生成式人工智慧是非常受歡迎的新興市場。蘇姿豐博士還強調了ROCm內部為支持各種大型語言模型所做的工作,並且隨著客戶積極的響應,會盡快提供進一步的更新。 ...

AMD確認代號Bergamo的EPYC將於2023H1推出,Instinct MI300要等到2023H2

AMD去年憑借基於Zen 4架構、代號Genoa的第四代EPYC伺服器處理器,領先英特爾代號Sapphire Rapids的第四代至強可擴展處理器幾個月進入2023年。AMD今年計劃推出四款全新的數據中心產品,包括Genoa-X、Bergamo、Siena和Instinct MI300。

AMD在2022年第四季度財報電話會議上,再次確認了基於Zen 4c架構、代號Bergamo的EPYC伺服器處理器將會在2023年上半年推出,不過Instinct MI300要等到2023年下半年。

Bergamo針對計算密集應用進行了優化,刪除了某些不需要的功能並提高了密度,最多擁有128個核心,競爭對手除了英特爾的同類產品,還有各種針對雲服務的Arm處理器。相比於普通的EPYC伺服器處理器,Bergamo有著更高的電源效率和每插槽性能,並與Genoa/Genoa-X採用相同的插座,也會支持PCIe 5.0、DDR5和CXL 1.1。

Instinct MI300是AMD面向數據中心的下一代APU加速卡產品,採用了Chiplet設計,擁有13個小晶片,通過3D堆疊的方式,包括了24個Zen 4架構CPU內核、基於CDNA 3架構的GPU模塊、以及128GB的HBM3顯存,共1460億個電晶體。其中的小晶片以5nm和6nm工藝製造,其中5nm的有9塊,6nm的有4塊。據推測,Instinct MI300的9個計算模塊里,有3個屬於CPU,6個屬於GPU。這是AMD迄今為止最大的晶片,超過了英特爾1000億個電晶體的Ponte Vecchio。

AMD在CES 2023上並沒有透露太多Instinct MI300的細節,只是簡單地與Instinct MI250X做了部分性能比較,AI性能是後者的8倍,每瓦性能則是後者的5倍。美國勞倫斯利弗莫爾國家實驗室(LLNL)的ExaFLOP級El Capitan超級計算機計劃在2023年末部署,將會採用Instinct MI300。 ...

AMD更新RDNA/CDNA架構路線圖:RDNA 3每瓦性能提升超50%,2024推RDNA 4

AMD在今天凌晨的財務分析師日活動上,更新了GPU的RDNA/CDNA系列架構路線圖,AMD Radeon技術事業部工程研發高級副總裁David Wang介紹了下一代RDNA和CDNA產品的相關情況。

AMD確認了RDNA 3架構將採用5nm工藝和小晶片設計,這將是其首款採用MCM多晶片封裝的消費級GPU,每瓦性能相比RDNA 2架構提高50%以上。對應的Navi 3x系列GPU將會在今年晚些時候到來,暫時不能確認官方PPT中出現的顯卡是否屬於Radeon RX 7000系列,從外觀上看,散熱器的設計與現有的Radeon RX 6000系列比較相像。

AMD表示,RDNA 4架構對應的是Navi 4x系列GPU,將採用更為先進的工藝製造,應該會在2024年推出,與CPU的Zen 5架構在時間線上類似,不過此次AMD並沒有透露太多有關RDNA 4架構的細節。

此前就有報導指出,數據中心使用的下一代Instinct MI300系列GPU可能會提供多種規格,配備的HBM3顯存堆棧可能分別會從兩個到八個。基於CDNA 3架構的產品會採用3D晶片堆疊技術,在小晶片的下方會有一個帶I/O接口的基礎模塊,而每個基礎模塊可以連接兩個HBM3顯存堆棧,採用6nm工藝製造,而計算模塊則採用5nm工藝製造。

Instinct MI300系列除了作為GPU出現,也可以是APU,將Zen 4架構和CDNA 3架構的模塊封裝在一起,搭載的晶片會將CPU模塊與GPU模塊及記憶體一起封裝,稱為Exascale APU模式。

這次AMD也確認了以上的部分信息,證實了Exascale APU的存在,不過沒有透露具體的細節,比如CPU模塊所採用的架構等,而這款面向數據中心的產品將會在明年推出。

...

AMD Instinct MI300系列將會有APU版:將Zen 4架構與CDNA 3架構的模塊整合

此前有報導指出,Instinct MI300系列GPU可能會提供多種規格,配備的HBM3顯存堆棧可能分別會從兩個到八個。這款基於CDNA 3架構的產品會採用3D晶片堆疊技術,在小晶片的下方會有一個帶I/O接口的基礎模塊,而每個基礎模塊可以連接兩個HBM3顯存堆棧,採用6nm工藝製造,而計算模塊則採用5nm工藝製造。

近日AdoredTV泄露了一張AMD的PPT,據稱來自AMD內部的Instinct MI300系列計劃演示文稿,證實了Instinct MI300系列除了作為GPU出現,也可以是APU,將Zen 4架構和CDNA 3架構的模塊封裝在一起。

這個消息也不太讓人驚訝,畢竟過往就有報導稱,AMD還有一款稱為「SH5」的新伺服器插座,搭載的晶片可能會將CPU模塊與GPU模塊及記憶體一起封裝,稱為Exascale APU模式。

從過往曝光的Instinct MI300系列結構來看,其配備了至少六個HBM記憶體堆棧。無論是GPU版還是APU版,封裝後的大小應該是一樣的。AMD曾發表過一篇論文,名為「百億億次計算APU的設計與分析」,里面就討論了一種高性能的晶片設計,里面會包含CPU晶片、GPU晶片和HBM記憶體堆棧。 ...

AMD Instinct MI300或採用3D晶片堆疊:8個計算模塊,支持PCIe 5.0和HBM3

AMD去年推出了基於CDNA 2架構的Instinct MI200系列計算卡,這是第一款採用MCM多晶片封裝的GPU,是首款百億億級的GPU加速器。事實上,在Instinct MI200系列還沒有發布之前,就已經傳出了Instinct MI300系列的消息了,近期還出現在了Linux修正檔里。

據VideoCardz報導,Instinct MI300系列GPU可能會提供多種規格,配備的HBM3顯存堆棧可能分別會從兩個到八個。值得注意的是,Instinct MI300系列GPU可能會採用3D晶片堆疊,在小晶片的下方會有一個帶I/O接口的基礎模塊。據稱,每個基礎模塊可以連接兩個HBM3顯存堆棧,採用6nm工藝製造,而計算模塊則採用5nm工藝製造。

集成了計算模塊和基礎模塊的單一小晶片的尺寸大概在110mm² 左右,擁有四個小晶片的頂級型號的中介層將有約20000個信號引腳,相比M1 Ultra多出了一倍。功耗方面,一個小晶片大概是150W,最高端的型號的功耗將達到600W左右,與目前OAM規格的Instinct MI250X的560W相近。 ...

Instinct MI300系列或首次出現在Linux修正檔,AMD下一代怪獸級計算卡

AMD在去年年末,推出了基於CDNA 2架構的Instinct MI200系列計算卡,這是第一款採用MCM多晶片封裝的GPU,是首款百億億級的GPU加速器。在Instinct MI200系列還沒有發布之前,其實已經有報導指出,Instinct MI300系列已經在路上了。

近日有網友指出,最新的Linux修正檔里包含了一個AMD未發布的產品,名為GFX940,支持所有針對數據中心的功能,與Instinct MI200系列GPU的型號(GFX90a)非常相似。盡管型號上相似,但與代號Aldebaran的CDNA 2架構GPU相比存在一些差異,推測很可能是下一代基於CDNA 3架構的Instinct MI300系列。

傳聞Instinct MI300系列GPU會有四個計算模塊(GCD),如果按照Instinct MI200系列GPU的規模計算,將會有440個CU,28160個內核,並沿用MCM封裝技術。據稱CDNA 3架構並不是從CDNA 2架構遷移後做細微的修正,而是修改過的新架構,GPU最終布局與RDNA 3架構類似,但是會針對HPC細分市場做優化。 ...

AMD Instinct MI300仍將採用MCM封裝技術,或具有4個計算模塊

此前Coelacanth's Dream通過Github上提交的信息,根據代碼推算出代號Aldebaran的CDNA 2架構GPU可能的配置規格。結合更早之前的信息,Instinct MI200計算卡每個計算模塊的CU數量應該是128個,其中會開啟110個,再通過MCM(Multi-Chip-Module)封裝技術,那麼一塊Instinct MI200計算卡將配置220個CU。當然,也有可能採用全新的架構設計,每個計算模塊的開啟的CU數量為55個,整塊計算卡配置110個CU。

無論如何,根據AMD執行長蘇姿豐博士在今年5月份摩根大通舉行的第49屆全球技術、媒體和通信大會上的發言,基於CDNA 2架構的新產品會在今年內推出。除了MCM封裝技術,新一代產品還會採用下一代Infinity Fabric總線技術,以及支持第三代AMD Infinity架構,允許多達8路的同款GPU連接擴展到Exascale。

Instinct MI200計算卡尚未露面,但Instinct MI300計算卡已經在路上。據推特用戶@Kepler_L2透露,Instinct MI300計算卡GPU的規模將在Instinct MI200計算卡基礎上翻倍。AMD仍然會沿用MCM封裝技術,並會集成更多的計算模塊,CDNA 3架構的GPU或許會有四個計算模塊。暫時還不清楚Instinct MI300計算卡的GPU代號,應該也會採用巨型星球的名字。 ...