Tag: GPU

AMD野心勃勃打造20晶片合一的巨型GPU 然後……流產了

日前有消息稱,,基本等於向NVIDIA舉手投降。

但現在看起來,AMD並非沒有努力過,甚至相當野心勃勃,只可惜沒能成功。

曝料大神MLID給出的說法稱,AMD原本設計了一個怪物一般的頂級GPU晶片“Navi 4C”,不但升級RDNA4架構,還採用極為復雜的chiplet小晶片封裝,但已取消。

這一代的Navi 31/32就是多晶片整合封裝,但只有GCD、MCD兩種晶片,而且最多七顆。

Navi 4C則有多達15-20顆不同晶片,並且分為不同類型:基底之上首先是三顆AID、一顆MID,而每個AI之上最多三顆SED。

AID的意思是“主動中介層晶片”(Active Interposer Die),負責中間通信,其中還有大量TSV矽穿孔,並彼此橋接在一起。

MID的意思是“多媒體與輸入輸出晶片”(Multimedia and I/O die),包括多媒體與輸入輸出功能,類似現在的MCD。

SED的意思是“著色器引擎晶片”(Shader Engine Die),包括核心計算單元,類似現在的GCD。

此外應該還有顯存控制器晶片,但側視圖上看不到。

其實,AMD早早就申請了這種設計的專利,示意圖中可以看到基礎層、計算、橋接等多種用途的晶片模塊,只是要做成太難了。

根據此前曝料,Navi 4x系列還有Navi 4M、Navi 4X兩個代號,但不知道和Navi 41/42是怎樣的關系。

來源:快科技

數十萬張缺口 GPU瓶頸到底卡住了誰?

GPU Utils發布了一份關於英偉達GPU——主要是H100的研究報告,試圖梳理有關GPU供應和需求的相關問題。在這篇主要針對美國市場的報告中,我們看到了目前阻礙大模型和人工智慧發展的關鍵瓶頸GPU短缺是如何形成和發展的。

總的來說,GPU瓶頸的出現原因是多方面的,環環相扣的復雜工藝製造流程,半導體周期,對稀缺資源的搶占與恐慌乃至未曾預料到的人工智慧的突然爆發,都讓GPU算力變得無比緊張。

樂觀地看,2024年這一瓶頸或許會有所緩解。

H100 GPU

數十萬張缺口,一百五十億需求

每個想要在人工智慧爆發中分一杯羹的人都需要GPU。准確地說,是英偉達的A100和H100,它們在訓練和推理大模型中扮演關鍵角色。如果要想要從頭訓練大模型,至少需要上千張A100或H100,而推理和微調大模型也至少需要儲存100張。

具體到每家的數量上,報告匯總了一些數據:GPT4在1萬到2.5萬塊A100上訓練,Meta有2.1萬塊A100,特斯拉有7000塊,Stability AI有5000塊,谷歌雲大概有2.5萬塊H100,微軟Azure有1萬到4萬塊,甲骨文可能也有同樣多的H100。值得一提的是,Azure的GPU基本都用來供應OpenAI的訓練了。

而根據馬斯克的說法,GPT5的訓練可能會用到3萬到5萬張H100,因此對未來的估計上,報告指出OpenAI可能需要5萬張H100,Meta至少需要2.5萬張(也有人說實際上需要10萬乃至更多),所有的雲服務廠商,微軟、谷歌雲和亞馬遜雲以及甲骨文各需要3萬張,私有雲服務商,比如剛剛融資的CoreWeave等總需求是10萬張,而像Claude的開發者Anthropic這樣的初創公司也都至少需要1萬張GPU。

另外,一些金融公司比如JP Morgan等也在部署A100或H100,因此總體上看,對H100的需求超過了43萬張。

這還是不算中國市場的情況,由於制裁原因,字節跳動、百度、騰訊和阿里巴巴只能大量購買A100和H100的替代產品A800與H800,這一部分的需求沒有列入其中,根據《金融時報》的說法,其總額高達50億美金。

如果將這些數字相加,這就是目前英偉達面對的,總計規模高達200億美元的GPU需求。

H100家族,從單個GPU到組合擴展而成的工作站和伺服器。

黃仁勛沒有騙我,買的越多,省得越多

作為A100的更新版,H100擁有著更好的性能,盡管它的價格更昂貴,單張約為3.5萬美元。

根據產量需求和成本,大部分企業都把A100和H100混用以節省成本。具體來說,在大模型訓練環節往往會使用3.2Tb/無限帶寬(IB)的H100 GPU,在模型推理環節,則往往也可以使用A100。

相比A100,H100的升級主要體現在具有更低的緩存延遲和FP8計算能力,這兩者都顯著提升了顯卡處理模型的效率。另外,H100還具有更好的拓展性,方便實現大規模部署。

總的來說,H100的16位訓練速度快了2.3倍,推理速度快了3.5倍,而它的成本——根據報告所說,僅是A100的1.5倍到2倍。

這正是黃仁勛在不同場合都反復強調的,the more you buy, the more you save.買的越多,省得越多。

關於H100晶片的組合形式有多種,包括英偉達自己設計的DGX H100,但市場上大部分公司都選擇購買8個GPU版本的HGX H100伺服器,它是由英偉達的合作夥伴們生產的,價格大致在36萬到38萬美元之間。

HGX也有兩種版本,配備SXM接口或者PCIe接口,報告指出市場上70%到80%的需求都是SXM H100,因為這種接口可以實現最大的吞吐量並且不需要連接電源。

市場對H100的趨之若鶩,與競爭對手形成了鮮明的對比。

英偉達官方給出的關於訓練GPT3時A100和H100的不同表現對比

沒有對手

根據英偉達的更新節奏,直到2024年底或2025年,H100的升級版才會到來,在此之前它將繼續統領大模型市場。

競爭對手並沒有坐以待斃,比如AMD剛剛推出了名為MI300系列的晶片,英特爾也有名為Gaudi2的加速計算晶片,它們至少在理論上都是英偉達的競爭對手。

然而在實際上,他們面對著比英偉達更大的問題。

報告中主要指出AMD的問題。首先重新配置AMD的設備——就算它可以完美適用大模型訓練任務,也需要開發和調試的時間,這意味著在時間上會落後於競爭對手。

其次,一個模型的訓練成本接近3億美元,對晶片的需求往往會超過1萬張,沒有人會冒風險大規模使用除了英偉達以外的晶片。

最後,限制英偉達GPU的瓶頸——復雜的生產工藝,同樣也在限制著AMD的產量——MI250同樣難以獲得。

至於另一個競爭對手Gaudi2,由於英特爾自己擁有工廠因此它或許在產量上有比較優勢,但Gaudi2是一款幾乎全新的晶片,針對它的研究和測試還非常少,事實上英特爾自己還在對其進行各種配套開發和優化,預計到今年下半年晚些時候才能調試完畢,而這時H100已經上市一年多了。

因此總結下來,目前為止H100就是是訓練大模型最佳的GPU,沒有之一。

H100 NVL

GPU瓶頸到底在哪裡?

目前,H100的供應已經相當短缺,有傳言說微軟Azure和谷歌雲的容量實際上已經快用完了,亞馬遜雲也面對同樣的情況,傳言目前下單需要等數月乃至半年。

導致稀缺的原因是多方面的,最根本的是,GPU是一項極端復雜的技術,需要世界上最先進的生產工藝,而掌握這項工藝的工廠——台積電,它的產能是有限的。

目前H100都由台積電代工,使用4N工藝,也就是增強型5納米製程(相比之下A100使用的是N7),這幾乎是目前最復雜的晶片製作工藝,從開始生產到出售給客戶,H100中間經歷的生產、包裝和測試環節一共需要6個月左右,這就意味著對H100的生產需要英偉達和台積電進行提前的布局,這在半導體行業來說是經常的事,但這一次英偉達和台積電顯然都對H100需求出現了錯誤的判斷。

這很好理解,因為ChatGPT爆發是去年底的事,那時關於今年的生產計劃(至少是上半年的計劃)已經規劃好了,台積電總體的生產能力是有限的,還需要在不同的大客戶之間分配,而產能爬坡也需要一個很長的過程——不要忘記生產H100這種GPU包含著全世界最復雜的工藝流程。

報告中特別指出生其中之一的瓶頸在於所謂CoWoS封裝(Chip on wafer on Substrate晶片、晶圓、基板封裝),它目前的月產量是8000片,今年底有望提升至11,000片,2024年底則達到每月14,500至16,600片左右的水平,也就是說,想要提升一倍的產量,幾乎需要一年半的時間,這當然也是由於生產工藝異常復雜導致。

這直接影響了H100的生產,更何況並不是只有一家在使用CoWoS封裝工藝,英偉達的競爭對手AMD以及博通、思科和賽靈思等都同樣在使用這種工藝製作晶片,又一次,台積電的產能瓶頸限制了GPU的供應。

另外,H100所使用的HBM3系列內存也是一個生產難點。報告指出英偉達主要在使用SK海力士的內存,後者是這一領域的領軍者,特別是在HBM內存的研發上。HBM技術直接把內存堆棧放在GPU晶片上,實現了更高的帶寬和更低的功耗。今年4月20日,SK海力士宣布在全球率先研發出12層堆疊的HBM3內存,單顆容量達到24GB。內存容量越大,意味著GPU可以裝載下更大的模型,然而HBM3內存的生產過程也十分復雜,產量提升同樣困難重重,實際上另外幾家晶片大廠,比如三星和美光,都很難提升HBM內存的產量,據說SK海力士正在根據英偉達的要求增產,在剛剛過去的SIGGRAPH 2023上,黃仁勛發布了GH200超級晶片的更新版, 採用了增強的HBM3E內存,這可以看作是英偉達在內存領域同供應商密切協作的一個例子。

裝有8個H100 的...

造「核彈顯卡」,已經不能滿足英偉達了

每年 8 月,英偉達都會在全球最重要的計算機圖形會議 SIGGRAPH 上秀一秀「肌肉」。

五年前,英偉達 CEO 黃仁勛在 2018 SIGGRAPH 發布了首款支持光線追蹤的顯卡 Quadro RTX,這是英偉達自 G80 以來最重要的產品,把英偉達 GPU 從 GTX 時代推向了 RTX 時代。

彼時,英偉達還是一個非常純粹的圖形計算晶片廠商,滿腦子想的都是怎樣把 3D 渲染推向極致,其市值約為 814 億美元,還沒進入千億俱樂部。

但到了...

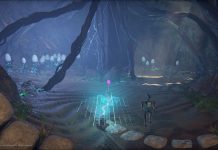

《瑞奇與叮當 : 時空跳轉》PC版支持DirectStorage 1.2,可實現GPU解壓資源

《瑞奇與叮當:時空跳轉(Ratchet & Clank:Rift Apart)》是索尼PlayStation 5的護航作品之一,由索尼第一方工作室Insomniac Games開發。其PC版將會在7月26日發售,包括Steam(售價414元)和Epic遊戲商店,預購遊戲即可優先解鎖兩款遊戲內物品,包括像素化槍武器和碳固護甲套裝。幾天前,官方公布了PC版的配置要求。

在PC版即將來臨之際,索尼PlayStation官方透露了《瑞奇與叮當:時空跳轉》的一些細節,比如遊戲將支持微軟最新的DirectStorage 1.2,包括利用GPU進行解壓資源。Nixxes Software的開發人員表示,為了實現即時轉換,遊戲需要快速載入材質,DirectStorage確保了加載的時間,GPU解壓縮功能可在高級圖形設置下使用,用於快速加載高質量的紋理和高水平的細節環境。

微軟在2021年3月正式推出了DirectStorage API,讓PC的NVMe SSD繞過CPU和內存,直接向顯存傳輸數據,可大幅降低遊戲加載的時間,理論上採用了該技術的遊戲可以做到場景的無縫接合。去年10月,微軟在DirectStorage 1.1里引入「asset decompression」功能,支持GPU解壓資源。今年4月,微軟帶來了DirectStorage 1.2,添加了新功能,並進行了一些修復,並優化了HDD使用性能。

《瑞奇與叮當:時空跳轉》本身是支持光線追蹤反射和光線追蹤陰影,用於自然戶外光線的場景。這次官方確認遊戲還將支持光線追蹤環境光遮蔽,增強了遊戲中環境遮擋的真實感。此外,《瑞奇與叮當:時空跳轉》還會支持英特爾的XeGTAO,是遊戲中的一個可選項目,需要搭配銳炫顯卡使用。開發團隊認為XeGTAO的輸出質量非常高,效果很好。 ...

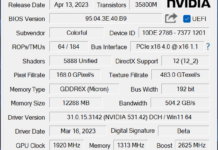

GPU-Z升級2.53版本,終於支持RTX 4070了

Techpowerup自去年12月更新了GPU-Z之後就很長一段時間沒有更新,上次更新加入了RX 7900系列和RTX

4070Ti的支持,而這幾個月里面也有不少新顯卡誕生,此前RTX

4070首發評測時軟體其實是沒有完全識別出顯卡的,今天他們終於把GPU-Z更新到2.53版本,加入了一堆新顯卡的支持。

新版軟體增加了對RTX 4070桌面顯卡的支持,還有RTX 40系列移動顯卡也有了支持,此外還有鮮為人知的採用GA104

GPU的移動版RTX 3060,以及RTX 3050 6GB移動顯卡。AMD方面,包括RDNA3架構的RX

7600S移動顯卡以及蘋果Mac系統獨占的Radeon Pro W6900X。

具體更新列表如下:

NVIDIA顯卡:GeForce RTX 4070、移動版RTX 4090/4080/4070/4060/4050、RTX

6000 Ada、移動版RTX 3060(GA104核心)、移動版RTX RTX 3050 6GB、RTX 2050、Hopper H100 PCIe、RTX

2080 Ti ES。

AMD顯卡:Radeon RX 7600S、Pro...

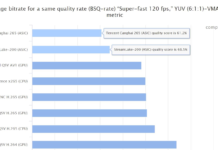

騰訊公布自研滄海晶片進展:大幅領先行業GPU 已量產投入數萬片

快科技4月17日消息,騰訊近年來也在研發晶片,日前該公司透露了其中的自研解碼編碼晶片“滄海”的進展,在MSU硬體視頻編碼比賽中,獲得了兩個賽道8項評分的全部第一。

具體來看,在SSIM (結構相似性)、PSNR(峰值信噪比)和VMAF(視頻多方法評估融合) 等多項評價指標省,滄海晶片大幅領先行業GPU等標品硬體。

2019年初,騰訊蓬萊實驗室、香農實驗室聯合啟動編解碼晶片”滄海“研發。對硬體編解碼的算法、架構和工程進行深度攻關,向高畫質、低延遲、低成本的“不可能三角”發起挑戰。

基於自身在底層軟硬體架構和音視頻領域的多年積累,研發團隊對每個模塊的計算任務都作了並行拆解。通過分配不同的計算單元,從而疊加大量處理任務;為滄海晶片內置視頻編碼加速專用功能模塊,讓流水控制邏輯更純粹,減少重復計算和分支判斷,帶來更低的功耗和成本。

滄海晶片的編碼器設計中完整實現了高精度運動搜索、全率失真優化、高效自適應量化等所有主流編碼工具,並融合騰訊雲軟體編碼器碼率控制等方面的領先技術,壓縮率高於市面標品35%以上。

在硬體架構上,通過將視頻預分析計算單元進一步卸載到硬體中,滄海晶片大幅減少了高密度轉碼場景下任務對CPU性能的依賴,將轉碼性能提升到更強。

通過靈活的多核擴展架構、高性能編碼流水線、層級化Memory布局,滄海晶片能滿足高吞吐、低時延和實時性要求。

根據MSU實測數據,從各項指標看,在同碼率下,相較於業界GPU等標品硬體,滄海能大幅改善畫面質量;

在120fps的高幀率檔位上,同等質量下,滄海比行業領先水平進一步節省10%以上的碼率。

另外,滄海晶片的單幀1080p的編碼耗時僅4毫秒,吞吐性能幾乎不受到編碼參數、視頻類型的影響。

去年3月,滄海晶片順利“點亮”,目前已經量產並投用數萬片,在雲遊戲、直點播等場景中,面向騰訊自研業務和公有雲客戶提供服務。

來源:快科技

450W功耗 Intel頂級GPU突然生變 只為賣給中國?

快科技4月11日消息,Intel在去年11月份發布了,包括三個不同型號,但是現在,Intel突然取消了其中的一款。

Intel GPU Max系列是Intel針對高性能計算加速設計的第一款GPU產品,基於全新的Xe HPC架構,多工藝、多晶片整合,具備5種不同工藝,電晶體數量超過1000億個,模塊多達47個。

頂級型號Max 1550具備滿血的128個Xe-HPC核心、128個光追核心、64MB一級緩存、408MB二級緩存、128GB HBM高帶寬記憶體,最高功耗600W,最多八卡並聯。

本次取消的是次級型號Max 1350,112核心,96GB記憶體,450W功耗。

它下邊還有個Max 1100,56核心,48GB記憶體,300W功耗,最多四卡並聯。

Intel表示,Max 1550原本是針對液冷設計的,但已經成功進行風冷部署,這就和Max 1350的定位產生了衝突,因此將其取消,改為再推出一款新的Max 1450,液冷、風冷均可,今年晚些時候正式推出。

Intel沒有透露Max 1450的具體規格,但有趣的是,Intel特別提到它將會降低IO帶寬。

這不由得讓我們想起美國對華禁售NVIDIA A100/HH100這樣的高性能GPU之後,出現了削減帶寬的版本A800、H800,可以正常賣給中國。

難道,Intel是為中國市場特意准備的Max 1450?

另外值得一提的是,Intel原計劃在今年推出下一代高性能GPU Rialto Bridge,2024年再發布全新XPU Falcon Shores,同時集成x86 CPU、Xe GPU,但最近決定取消Rialto Bridge,

,首次集成CPU、GPU,5nm工藝,1460億個電晶體,24個Zen4 CPU核心,未知數量CDNA3 GPU核心,8192-bit 128GB...

RTX 4060 Ti再爆新料:GPU頻率暴增

最近有爆料稱,英偉達即將推出RTX 4060 Ti顯卡,這也是繼RXT 3060 Ti之後,英偉達再次推出Ti後綴的60系顯卡。同時有消息表明,RTX 4060 Ti的GPU頻率可以達到驚人的2685MHz。

據悉,英偉達RTX 4060 Ti的基礎頻率為2310MHz,Boost頻率為2535MHz,而一些高端非公版型號Boost頻率則能夠達到2685MHz。

此外RTX 4060 Ti和RTX 4060的參數也已經遭到曝光,RTX 4060 Ti採用AD106-350核心,擁有4352個CUDA核心,配備12GB GDDR6顯存,顯存位寬為128bit。RTX 4060則採用AD107-400核心,擁有3072個CUDA核心,同樣配備8GB 128bit GDDR6顯存。

同時,RTX 4060 Ti的實物圖也已經出現在網絡上,從已經放出的圖片來看,這張顯卡在整體設計思路上延續了RTX 30系顯卡的風格,雖然在顯卡上印有RTX 4060的字樣,但爆料人稱這款顯卡實際上就是RTX 4060 Ti。

一直以來Ti後綴都屬於旗艦或是次旗艦型號,自從RTX...

《暗黑破壞神4》BETA會導致一些GPU過熱

《暗黑4》今日開啟了BETA全面公測,近日一些玩家反應《暗黑4》BETA會引起一些GPU過熱問題,暴雪目前正在調查情況。

媒體Eurogamer讀者「jonzie23」反應他在上週遊玩《暗黑4》時就遇到了GPU過熱問題。

他在Eurogamer網站評論上寫道:「我想總結下我周一的BETA體驗,大約玩了20分鍾,然後我的電腦忽然關機了。我發現我的顯卡很熱,當我摸HDMI埠時被燙了下。幸運的是,我的顯卡沒有永久損壞。我以為這是一個個例,但我發現實際上也有其他人遇到了這種情況,但他們沒有我這麼幸運。」

其他讀者建議Jonzie23在遊玩《暗黑4》時限制下幀數,以防類似問題再發生。同時暴雪也在戰網上給出了他們的建議。

「《暗黑4》團隊正在調查GPU過熱問題。我們正在和英偉達密切合作,識別受影響硬體的配置,收集盡可能的數據以幫助調查。

如果你的顯卡不工作了,試試以下步驟:

關閉電源-打開電源,看看顯卡是否能在Windows下被檢測;

如果在Windows下能被檢測出來,那麼安裝驅動。」

來源:3DMGAME

NVIDIA全球首發GPU量子計算 10倍性能提升

GTC 2023春季大會上,NVIDIA宣布與Quantum Machines合作打造了全球首個GPU加速的量子計算系統——NVIDIA DGX Quantum。

該系統結合了NVIDIA Grace Hopper CPU+GPU超級晶片、CUDA Quantum開源編程模型組成的全球最強加速計算平台,以及Quantum Machines的全球最先進量子控制平台OPX。

它能讓研究人員構建量子計算、先進經典計算相結合的超強應用,進而推動校準、控制、量子糾錯和混合算法的發展。

其中,通過PCIe連接到OPX+平台,能夠使GPU晶片和量子處理器(QPU)之間的延遲降低到亞微秒級。

Grace Hopper超級晶片集成了一顆Hopper架構GPU,以及一顆Grace CPU,能夠大幅提升超大型AI、HPC應用的性能。

對於運行TB級數據的應用,它能夠實現高達10倍的性能提升,可幫助解決世界上最復雜難題的量子經典計算。

OPX+是一個通用的量子控制系統,將實時經典計算引擎加入到量子控制堆棧的核心,從而最大程度地提高QPU性能,並為量子算法開辟了新的可能性。

從幾個量子比特的QPU,到一個量子加速的超級計算機,Grace Hopper和OPX+系統都可以根據系統大小,進行靈活擴展。

CUDA Quantum是一個混合量子經典計算平台,能夠在一個系統中實現QPU、GPU和CPU的集成和編程,現已開源。

CUDA Quantum同時也迎來了一批新的合作夥伴,包括量子硬體公司Anyon Systems、Atom Computing、IonQ、ORCA Computing、Oxford Quantum Circuits、QuEra;量子軟體公司Agnostiq、QMware;超算中心——日本國家高級產業科學技術研究院、IT Center for Science(CSC)、美國國家超級計算應用中心(NCSA)。

來源:快科技

派若樂發布4U GPU伺服器:10塊NVIDIA顯卡、8000W電源

近期,ChatGPT所取得的技術突破引起學術界和產業界的熱烈討論,有專家提交的一份提案,建議建立大型科技企業+重點科研機構的產研協同創新模式,打造中國的“微軟+OpenAI”組合引領大模型技術攻關。

在過去的兩年時間里,派若樂一直在布局AIoT解決方案,將自己定位為一個全面的人工智慧平台解決方案供應商。

日前,派若樂推出了一款4U機架式高密度GPU伺服器“HPCStackRS680-G10i”,一款支持適用於人工智慧訓練端的GPU解決方案,從AI推理到訓練,讓AI成為可能。

HPCStackRS680-G10i高密度GPU伺服器主要功能有:

採用兩顆Intel至強第三代金牌系列處理器,提供多達12條PCIe4.0擴展插槽,實現更高的帶寬,提升數據傳輸率。

GPU優化設計,支持10塊雙插槽主動式或被動式加速卡,均來自NVIDIA,但未披露具體型號。

支持NVIDIANVLink網橋,可擴展性能以滿足視覺運算工作負載需求。

多達24塊2.5英寸硬碟位,四塊冗餘2000W熱插拔電源,優化的節能散熱設計、獨立的CPU和GPU風道,為GPU和CPU提供更好的散熱,使熱量傳遞到周圍的空氣中,以提高能效和整體的節能。

2個Intel晶片千兆乙太網絡接口,支持OCP3.0接口網卡擴展,集成ASPEEDAST2600BMC顯示晶片。

集成1個千兆AST2600BMC管理埠,支持IPMI2.0協議遠程管理,可激活高級管理功能,滿足數據中心大規模部署。

在深度學習領域,應用程式需要更多與可擴展性並行工作的GPU功能。通過採用均衡負載模式,RS680-G10i實現了點對點功能,縮短了GPU卡之間的延遲,同時加快了計算時間。

目前GPU高性能計算(HPC)已經滲透到社會的各個角落,基於派若樂技術有限公司的HPCStack商用級高性能計算(HPC)集群一體化解決方案能夠幫助企業、高等院校、科研機構等組織單位加快大量數據模型的處理並提高應用的解決質量與效率,可為用戶提供可靠、穩定的、強大的計算力。

來源:快科技

顯存身價飆升5倍 GPU又要缺貨了:顯卡重新漲回來

GPU圖形產品面臨新的缺貨漲價風險,這次不是拜挖礦所致,而是AI人工智慧,尤其是最近大火的生成式聊天機器人ChatGPT。

據媒體報導,包括三星、SK海力士在內的主要DRAM廠商已經提高了對顯存晶片產品的報價,先進的HBM3,居然飆升了5倍之多,要知道HBM均價本就是普通DRAM的3倍,畢竟生產工藝和技術更復雜。

得益於超高帶寬,HBM3已經得到NVIDIA計算卡H100搭載,Intel前不久推出的x86處理器Xeon Max上面也使用了HBM2e。

當然,三星也有存算一體這樣的解決方案,比如HBM-PIM(Aquabolt-XL)晶片,可提供1.2T算力,SK海力士去年開發出具備計算功能的GDDR6-AiM,外界預計AI將至少在圖形計算、加速器這一領域拯救低迷的DRAM需求。

但隨之而來另一個隱憂是,業內對AI包括機器學習訓練的跟風,或將導致GPU晶片再度短缺。據了解,為了創建和維持ChatGPT所需的人工智慧分析數據的龐大資料庫,開發者使用了10000個英偉達的GPU進行相關的訓練。

而目前為了滿足當前伺服器的需求,ChatGPT的開發商OpenAI已使用了約2.5萬個英偉達的GPU,隨著需求的增加未來預計還會增加。每有1億活躍用戶,ChatGPT就需要13.5EPLOPS的算力,大約是6.9萬台NVIDIA DGX A100 80G伺服器支撐,而目前全球的算力也只能支撐1億日均上線人數。

有專業人士推算,如果Google搜索全面集成Bard平台AI技術,需要512820台A100 HGX伺服器,將需要超過410萬個A100 GPU。

來源:快科技

腦洞大開的機械鍵盤 內部竟搭CPU和GPU

傳統認知中,機械鍵盤在功能上的最高境界就是玩玩燈效,然而今天要給大家介紹的這款機械鍵盤可謂是打破了大眾的傳統認知。

這款名為“Centerpiece”的機械鍵盤自帶CPU和GPU,鍵盤按鍵下方嵌入了一塊LED全顯屏,能夠播放動畫效果,配備搭載透明鍵帽和Gateron佳達隆全透矮軸。

由於內部配置強大,因此這塊顯示屏播放的並不是預渲染視頻,而是基於虛幻5引擎製作,能夠與用戶操作實時做出反應的動畫特效。

官方表示這款鍵盤一次最多支持三個皮膚,可以從Steam市場上加載。

此外,廠商還專門強調這款鍵盤並不是裝飾品,而是能夠承受高強度使用,可以作為日常鍵盤“折騰”的產品。

該鍵盤預計將在明年正式投產發售,定價為349美元(約合人民幣2439元)。

來源:快科技

核顯的春天來了 SK海力士發布最快LPDDR5T記憶體:飆上9.6Gbps

1月25日,SK海力士宣布,已成功開發出目前速度最快的移動DRAM:LPDDR5T(Low Power Double Data Rate 5 Turbo),後綴T代表Turbo,表示更快的意思。

新產品LPDDR5T運行速率高達9.6Gbps,比2022年11月推出的上一代LPDDR5X要快了13%。海力士已於近期經向客戶提供了LPDDR5T記憶體樣板,為16GB容量的封裝,帶寬高達77GB/。

LPDDR5T兼具了高速度和低功耗的特性,在JEDEC設定的1.01V至1.12V超低電壓范圍內運行,同樣集成了HKMG工藝,並計劃採用1αnm工藝製造,以實現最佳的效能。

除了能用在高端智慧型手機上,LPDDR5T同樣可以用在筆記本電腦上。9.6Gbps的LPDDR5T記憶體以雙通道形式存在封裝在筆記本內部,帶寬可以翻倍到154GB/。作為對比,售價1888元的AMD RX 6500 XT顯存帶寬為144GB/。

AMD即將上市的銳龍7040H系列移動處理器,內置的Radeon 780M GPU,擁有1536個RDNA3流處理器(等效),如果配上LPDDR5T記憶體,其性能或許能接近到RTX 3050的水準。

來源:快科技

用牙膏和番茄醬替換GPU塗抹的矽脂後:顯卡溫度神了

大夥常見的晶片用散熱材料主要有矽脂、液金、導熱膏等,除了業內在孜孜以求效果更超群的新材料,民間愛好者們也拓展了自己的好奇心。

日前,德國CB進行了一次趣味的顯卡散熱探索,嘗試用包括奶酪、番茄醬、牙膏、土豆片甚至祛疹軟膏來代替矽脂,作為GPU晶片的散熱材料,最終結果如何呢?

測試平台選取的是30W熱設計功耗的Radeon R7 240,方法是在Furmark烤機,並記錄5分鍾的溫度讀數。

讓人意外的是,番茄醬、部分牙膏產品的散熱表現非常搶眼,最低可以做到保持GPU在63攝氏度。相較而言,一些專業導熱膏居然因為裝上105攝氏度溫度牆,而不得不提前降頻。

當然,這里並不是鼓勵大家用牙膏或者番茄醬代替矽脂、液金,而是提醒部分導熱膏廠家,相關產品的品質仍舊亟待提高。

來源:快科技

自主架構圓滿了 龍芯2K2000流片成功:自研GPU、功耗約4W

龍芯中科官方宣布,2022年12月中,龍芯2K2000通用型SoC晶片流片成功,並完成初步功能調試、性能測試,達到設計目標。

目前,龍芯2K2000已全面展開解決方案調試,近期將推出試用。

龍芯2K2000集成兩個基於自主龍架構的LA364處理器核,共享2MB二級緩存,典型工作頻率1.5GHz,SPEC2006INT(base)單核定/浮點分值達到13.5/14.9分。

同時,龍芯2K2000還集成了龍芯自主研發的LG120 GPU圖形核心,並進一步優化了圖形算法和性能。

I/O接口非常豐富,支持64位DDR4-2400 ECC記憶體、PCIe 3.0、SATA 3.0、USB 3.0/2.0、HDMI/DVO顯示接口、GNET/GMAC網絡接口、音頻接口、SDIO/eMMC等接口。

此外還集成了安全可信模塊,Rapid IO、TSN、CAN等特色工業接口。

塑封版本採用FC-BGA883封裝,長寬尺寸為27 x 27mm,同時支持高等級封裝。

得益於片內豐富的低功耗控制方法,龍芯2K2000功耗的可伸縮性良好,初步測試結果顯示在高性能模式下約為9W,平衡性能模式下約為4W,可滿足多種應用場景的需求。

龍芯中科表示,將在龍芯2K2000設計平台的基礎上,開發一系列針對不同細分領域的SoC晶片,更精準地服務客戶需求。

就在日前,,功能正常,性能符合預期。

隨著龍芯2K2000的推出,龍芯自主指令系統LoongArch(簡稱龍架構)的產品,已經形成了工控型1C102、1C103,工控/通用型2K0500、2K1000LA、2K1500、2K2000,消費型3A5000,伺服器型3C5000、3D5000等組成的完整系列,性能從高到低全覆蓋。

來源:快科技

AMD首個Chiplet GPU什麼水平?有希望價格會下降

RDNA 3 代表了 AMD RDNA 架構的第三次疊代,它在其消費類圖形產品線中取代了 GCN。

在較高層面上,與 RDNA 2 相比,RDNA 3 的目標是大規模擴展。緩存設置在各個層面進行了調整,以提供更高的帶寬。為了擴展計算吞吐量而不僅僅是添加更多 WGP,AMD 為通用指令的子集實現了雙重發布功能。

在本文中,我們將對 7900XTX 進行一些微基準測試,看看與 AMD 的 RDNA 2 架構相比的差異。我們還將結合Nemes 的 GPU 微基準測試套件的結果。

雖然我對...

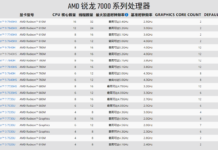

AMD低調發布銳龍7000H:核顯頻率秒殺獨顯 功耗放開45W

CES 2023大會上,AMD面向移動平台集中發布了銳龍7045HX系列、銳龍7040HS系列、銳龍7035HS/U系列、銳龍7030U系列,但是沒看到此前的H系列標壓高性能版,一度以為它被HS系列徹底取代了。

但是在AMD官網上,悄然出現了銳龍7040H系列,核心規格與銳龍7045HS系列完全一致,只是默認TDP熱設計功耗從35W放寬到45W,最高依然允許調節到54W。

銳龍7040H系列依然採用最先進的4nm工藝,內核面積178平方毫米,Zen4 CPU架構搭配RDNA3 GPU架構,記憶體支持雙通道DDR5/LPDDR5/LPDDR5X。

也有三款型號——

銳龍9 7940H:

8核心16線程,一級緩存512KB,二級緩存8MB,三級緩存16MB,主頻4.0-5.2GHz,集成Radeon 780M,12CU單元,頻率3.0GHz。

銳龍7 7840H:

8核心16線程,一級緩存512KB,二級緩存8MB,三級緩存16MB,主頻3.8-5.1GHz,集成Radeon 780M,12CU單元,頻率2.9GHz。

銳龍5 7640H:

6核心12線程,一級緩存384KB,二級緩存6MB,三級緩存16MB,主頻4.3-5.0GHz,集成Radeon 760M,8CU單元,頻率2.8GHz。

其中的銳龍700M系列核顯尤為值得一提,RDNA3最新架構加多達12個單元,而且,性能史無前例。

根據官網規格表,它支持最新的DP 2.1(UHBR 10)、HDMI 2.1、USB-C DP Alt模式輸出,最多四屏,輸出解析度/刷新率支持7680x4320 @ 60Hz、3840x2160 @ 240Hz、3440x1440 @ 360Hz、2560x1440 @ 480Hz、1920x1080 @...

在發售2年後,Meta為Quest 2解鎖了更高的GPU Boost頻率

近日,Meta在Blog網誌中宣布,將會為Quest 2解鎖更高的GPU Boost頻率,讓VR開發者們擁有更多的GPU資源可用。

確切點來說,Quest 2的GPU頻率提升幅度為7%,從490MHz上升到525MHz。Meta認為開發者可以藉助本次頻率的提升來讓VR應用和遊戲內的渲染解析度更高一些。附帶一提,Quest 2的SoC為高通驍龍XR2,它的GPU為Adreno 650。同樣使用這款GPU的SoC還有高通驍龍865、865+和870。

(圖片來源:Meta)

Meta還提到,所有的開發者都能夠馬上享受這次頻率提升而不需要等待系統的升級,在現時的V47系統中,只需要讓頭顯休眠再喚醒,或者直接按動電源按鈕兩次,就能讓GPU頻率的上限提升;而在未來的V49系統中,GPU頻率的提升會包含在內,不需要再次操作。

另外,Meta表示這次更新也不需要開發者為應用添加任何新的代碼,系統會自動提升GPU的頻率,而對於加入注視點渲染功能的應用,系統會選擇利用更高的頻率去渲染更高的畫質,而不是增大注視點渲染的清晰范圍。

(圖片來源:Meta)

考慮到新的一年里面會有更多的VR一體機推出,外加還有PlayStation VR2這種高性能的頭顯,Meta為Quest 2提頻這事也很好理解:讓一些多平台發布的VR遊戲能夠在Quest 2上擁有更好一點的表現。不過總的來說高通驍龍XR2也是到了該換代的時候了,要想戰未來那還是得新硬體啊。 ...

AIDA 64 v6.85發布:支持AMD RDNA 3架構GPU

FinalWire Ltd.宣布推出AIDA 64 Extreme v6.85軟體,這是一款面向家庭用戶的簡化診斷和基準測試工具。其提供了多項功能,幫助用戶超頻、硬體錯誤診斷、壓力測試和傳感器監控,具有獨特的功能來評估處理器、系統記憶體、磁碟驅動器和支持OpenCL的GPU的性能。

此外,還有面向企業IT技術人員和工程師的AIDA64 Engineer 6.85軟體、面向中小型企業的AIDA64 Business 6.85軟體、以及面向網絡審計領域的AIDA64 Network Audit 6.85軟體。

在該版本AIDA 64中,為AMD Ryzen 7000系列處理器引入了經過優化的AVX-512壓力測試,並支持英特爾和AMD最新的CPU平台,以及英偉達和AMD最新的GPGPU和圖形技術。

AIDA 64 v6.85新功能和改進說明:

針對AMD Zen 4架構Ryzen 7000系列處理器的AVX-512基準測試進行了優化

SmartCool LCD顯示屏的支持

增強了對英特爾B760晶片組主板的支持

海盜船HX1000i 2022、海盜船HX1500i、技嘉Aorus電源單元傳感器支持

AMD Radeon RX...

Intel重回高性能GPU市場 Xe HPG微架構潛力無窮

2022年Intel接連發力,在6月份率先推出了旗下首款高性能桌面級GPU A380,雖然定位入門級,卻也初具規模。

而在同年10月再次推出了中高性能的A750/A770桌面級GPU,本次的兩款顯卡一躍達到了市場主流產品的水準,雖然尚未達到旗艦級發燒性能,但其潛力可見一斑。

下面則為大家簡單解析一下Intel的Xe HPG微架構,到底有何玄妙之處。

Xe HPG微架構淺析

本代Intel 3款顯卡採用了Xe HPG微架構設計,最初發布的入門級A380顯卡包含8個Xe內核(Xe Core),即兩個渲染切片(Rendering Slice),下面我們從最小的Xe Core逐步為大家講解。

Xe Core

每個Xe Core包含16個256位寬的(XVE)矢量引擎,它主要負責傳統圖像處理計算的任務,且提供大部分運算。

同時由於AI算法核心幾乎完全圍繞著一系列大型矩陣算法和累加算法,所以每個Xe Core還包含16個1024位寬的矩陣引擎(XMX),主要為加速AI運算而生。

為了滿足矩陣、矢量和光線追蹤單元的高帶寬需求,每個Xe Core中還構建了一個192KB的大型本地記憶體。它可以根據每個工作負載的需要在L1緩存和共享本地記憶體(SLM) 之間動態分配。

Render slice

綜上所述,每4個微小的Xe Core,將構成一個Render slice(渲染切片)。除此之外,每個Render slice還集成了幾何處理、光柵化、紋理采樣、像素處理和光線跟蹤等主流圖形技術。

新的光線追蹤單元架構可為DirectXRaytracing和Vulkan RT提供全面支持,通過加速光線遍歷、光線盒交叉點和光線基元交叉點實現逼真的閃電和視覺保真度。

Xe HPG

Xe HPG架構最大的特點就是出色的靈活性,Intel可通過疊加渲染切片的方法來構建不同核心,目前最少為2個(8 Xe Core),最大可以做到8個(32 Xe...

NV的750張顯卡 看完73萬條遊戲視頻後:學會了玩《我的世界》

750張NVIDIA的頂級顯卡,可以做什麼創意工作?

MineDojo項目的答案是,學會玩最受歡迎的遊戲之一《我的世界(Minecraft)》。

NVIDIA的一批工程師,使用32張A100、720張Tesla V100 GPU,在為AI模型輸入了73萬條遊戲視頻、7000頁百科文檔、34萬網友發帖以及660萬玩家互動評論後,達成了創舉。

操控AI模型的方法很簡單,你只需要用直白的語言下達命令,就比如“在沙漠中發現金字塔”“建造下界傳送門(nether portal)並進入”等。

當AI模型可以在不到4分鍾的時間里造出一把鑽石鎬的時候,研究人員知道,他們的付出沒有白費。

據悉,MineDojo的相關論文還獲得了NeurlPS 2022獎項,包括MineCLIP交互模型也上傳GitHub了。

來源:快科技

NVIDIA AD104 GPU核心現身:RTX 4070 Ti或將用上

今天,根據VideoCardz方面消息,爆料人MEGAsizeGPU曝光了NVIDIA AD140 GPU的外觀,不出意外,這顆CPU將被用在RTX 4070 Ti身上。

據悉,此次曝光的AD140-400應該是滿血版本,共計擁有7680個CUDA核心、240個Tensor內核和60個用於光線追蹤的內核。

尺寸上,這款GPU約為 295 平方毫米,是旗艦AD102 GPU的一半,比上代GA104 GPU小約100平方毫米。

同時,AD104不僅內核更少,其192位寬總線也僅支持6GB或12GB等記憶體配置。

由此來看,這顆新的GPU主要針對的是性能相對較差的顯卡,我們很可能會在RTX 4070 Ti,以及其他RTX 40系中端顯卡中見到它的身影。

目前,NVIDIA還未放出關於RTX 4070 Ti的相關消息,但從目前的情況來看,它大機率會在明年年初的CES 2023上亮相。

來源:快科技

Intel正式發布Max GPU:1000+億電晶體、600W峰值功耗

新一屆超算大會到來之際,Intel正式發布了兩款全新的HPC/AI計算產品,並劃入全新的Max系列,明年1月上市。

一個是至強CPU Max系列,代號Sapphire Rapids HBM;一個是數據中心GPU Max系列,代號Ponte Vecchio。

關注硬體的朋友對這兩個代號名字應該很熟悉了,磨嘰了幾年終於要落地了,將攜手用於美國能源部阿拉貢國家實驗室的百億億次級超算“Aurora”,和AMD EPYC處理器、Instinct計算卡組成的“Frontier”一個性質。

這一篇先說說Max GPU。

這是Intel針對高性能計算加速設計的第一款GPU產品,基於全新的Xe HPC架構,和桌面上的Arc系列顯卡同源,但面向計算而非圖形。

Max GPU採用了多工藝、多晶片整合製造,5種製造工藝,總計擁有恐怖的1000多億個電晶體,集成多達47個模塊(tile),包括基礎單元、計算單元、Foveros封裝單元、EMIB封裝單元、Rambo緩存單元、HBM記憶體單元、Xe鏈路單元,等等。

最多擁有128個Xe-HPC核心、128個光追核心,一級緩存就有64MB,可提升吞吐和性能,二級緩存更是多達408MB二級緩存,業內密度最高,還集成最多128GB HBM高帶寬記憶體。

Max GPU是業界唯一支持光追的HPC/AI GPU,可用於科學視覺、動畫等工作的加速。

具體分為三款型號:

- Max 1550:

滿血狀態,128核心,128GB HBM,OAM形態,最高功耗達600W,最多八路並聯。

- Max 1350:

112核心,96GB HBM,OAM形態,450W功耗,最多八路並聯。

- Max 1100:

56核心,48MB HBM2e,PCIe形態,300W功耗,可通過Xe Link橋接器最多四卡並聯。

性能方面,Intel宣稱,對比NVIDIA A100,Riskfuel金融分析性能領先最多2.4倍,NekRS核模擬物理性能領先最多1.5倍。

至於為何不對比最新的NVIDIA...

NVIDIA GPU被封鎖出口 將向中國推出定製的A800

今年8月,美政府對NVIDIA A100、H100兩款加速計算GPU實施禁令,不得銷售給中國。NVIDIA創始人兼CEO黃仁勛隨後表示,會推出替代版本。

據《每日經濟新聞》報導稱,NVIDIA將面向中國用戶推出新的A800 GPU,用於替代A100,其符合美政府出口管制政策。

根據美政府的政策,用於出口的晶片數據傳輸率不得超過600GB/,NVIDIA A800則設定在400GB/。

但其他規格尚不清楚,比如核心數量、運行頻率、顯存、功耗等。

NVIDIA A100 GPU採用全新Ampere安培架構的超大核心GA100,7nm工藝,542億電晶體,826平方毫米麵積,6912個核心,搭載5120-bit 40/80GB HBM2顯存,帶寬近1.6TB/,功耗400W。

對於NVIDIA來說,中國市場同樣異常重要。

根據財報數據,NVIDIA過去一年在中國市場收入達71.11億美元,占總收入的26.4%。

但是眼下,NVIDIA的業績正面臨嚴峻挑戰,尤其是“礦卡”需求已經不再。

第二財季,NVIDIA總收入67億美元,環比下跌19%,淨利潤6.56億美元,環比下跌59%。

其中遊戲業務收入僅為20.4億美元,同比減少33%,環比減少44%,預計第三季度總收入將再次下跌17%。

雙11紅包活動推薦:

來源:快科技

DirectStorage 1.1現已可用於PC,能使用GPU進行解壓縮

據wccftech報導,微軟現已正式宣布DirectStorage 1.1適用於PC。現在DirectStorage 1.1可供任何希望在遊戲中使用該技術的開發人員使用。DirectStorage API允許PC開發人員更高效地從NVMe固態硬碟傳輸數據,從而減少處理耗時,這個也是Xbox Series X/S的「Velocity Architecture」宣傳點之一,現在通過DirectStorage也能在PC上面得到實現。

微軟開發人員Cassie Hoef也對DirectStorage 1.1進行了詳細的描述:

「遊戲需要大量數據來構建沉浸式世界——每個角色、物體和風景...加起來多達數百GB的數據。為了減小遊戲的整體包大小,這些數據將被壓縮。運行遊戲時,這些數據將傳輸到系統記憶體,CPU在將數據復制到 GPU記憶體並根據需要對相關數據進行解壓縮。這些數據在遊戲設備上的傳輸和解壓縮極大地增加了加載時間,也限制了開放世界場景中可以存在的細節。

DirectStorage 1.0改進了此過程的數據傳輸部分。Windows 11的進步與DirectStorage相結合,使開發人員能夠利用NVMe驅動器的更高帶寬。這樣,安裝在NVMe驅動器上並啟用DirectStorage的遊戲預計加載時間最多可減少 40%。在增強數據傳輸的這一部分之後,開發人員接下來將希望提高解壓縮性能。

通常,解壓縮工作是在CPU上完成的,因為壓縮格式過去只針對CPU進行了優化。我們在DirectStorage 1.1中提供了一種替代方法,將這些數據的解壓縮轉移到GPU進行,稱為「GPU解壓縮」圖形卡在並行執行可重復任務方面效率極高,我們可以利用這種能力以及高速NVMe驅動器的帶寬來同時完成更多工作。因此,加載數據所需的時間會減少,從而減少關卡的加載時間並改善開放世界流式傳輸。"

基於微軟高度優化的測試,具有GPU解壓縮功能的DirectStorage 1.1的加載速度比DirectStorage 1.0快3倍。

雖然DirectStorage表現出了巨大的潛力,但是目前還很少軟體或遊戲對其進行適配,不過Square Enix將於明年一月份發布的新作《FORSPOKEN》將會是第一個適配DirectStorage的遊戲,希望未來會有更多廠家適配DirectStorage。 ...

Phat!: 1/7 優秀素質 原型圖

【フィギュア情報!】

ファット・カンパニーから発売予定の1/7スケールフィギュア「ナイスネイチャ」の開発が進行中!

製作中のフィギュア原型を公開しました!

詳細は続報をお待ちください♪

來源:78動漫

GPU大亂鬥:蘋果A16竟超越AMD銳龍9 Intel小勝M1 Pro

無論是台式機、筆記本,還是手機、遊戲機,GPU圖形晶片無處不在,但跨平台對比它們的性能並不容易,因為技術路線各不相同,很難統一衡量。

Basemark近日推出了全新的GPU測試工具“Sacred Path”(神聖之路),可以考察幾乎所有平台GPU的性能。

當然,因為系統、API的差異,測試成績可能會有很大的波動,同一設備的結果可能高低相差50%,但依然可以作為很好的參考。

Tom's Hardware從官方資料庫中,選取了大量設備的最高成績,將它們分成不同級別進行對比,最有趣的當屬手機、掌機、集成顯卡這一組。

蘋果M系列、A系列一枝獨秀,A16的表現已經超過了Steam Deck掌機里AMD Van Gogh定製處理器的RNDA2 8單元(1.6GHz),也超過了銳龍9 5900HX集成的Vega 8單元(2.1GHz),蘋果A15甚至都能非常接近後者。

可惜沒有加入銳龍6000H系列集成的RDNA2 12單元,它應該能幹掉蘋果M1。

另外,高通驍龍8 Gen1略微領先三星基於AMD RDNA2架構自研的Xclipse 920,並碾壓聯發科天璣9000集成的Mali-G710 MC10。

再看入門級組別,Intel Arc A380竟然只是勉強超過蘋果M1 Pro,同時還遠不如移動版的RTX 3050,對比M1 Max更是低了幾乎一半。

新發布的Intel Arc A770/A750沒有列出,它們和RTX 3060基本同一檔次。

中高端和旗艦組都是Intel、AMD的桌面和筆記本顯卡,就不多說了。

來源:快科技

Basemark推出GPUScore Sacred Path:跨平台GPU基準測試套件

Basemark在今年3月份發布了GPUScore,這是一種全新的GPU性能基準測試套件,適用於智慧型手機到高端遊戲PC。GPUScore支持所有現代圖形API,包括了Vulkan、Metal和DirectX,支持Windows、Linux、macOS、Android和iOS等作業系統。

GPUScore包含三個不同的測試套件,當時推出的是第一個套件,名為Relic of Life,可以單獨使用。Relic of Life主要針對高端遊戲PC的獨立顯卡進行基準測試使用,要求支持硬體加速的光線追蹤功能,支持Vulkan和DirectX,並適用於Windows和Linux作業系統。到了今年8月份,Basemark推出了第二個套件,名為The Expedition,針對的是Android和iOS的高端智慧型手機和其他移動設備。

今天Basemark宣布推出第三個套件,名為Sacred Path。Basemark稱,這是目前唯一一個跨平台GPU基準測試,其中包含了最新的GPU技術,比如可變速率著色(VRS)。GPUScore:Sacred Path支持所有相關的設備類別,從高端智慧型手機到高端遊戲PC的獨立顯卡,對主要作業系統也做了全面支持,包括了Android、iOS、Linux、macOS和Windows。

Basemark表示,如果期望GPU基準測試結果能用於比較且誤差最小,那麼使用GPUScore是一個很好的選擇,滿足支持不同GPU的需求。GPUScore的三個測試套件在開發過程中,與其開發計劃成員有著密切的技術合作,其中包括了Arm、Imagination Technologies、聯發科、英偉達、高通和三星等。通過與行業領導者的密切合作,可確保基準測試的質量和使用圖形行業最新的技術。 ...

NVIDIA 4nm GPU性能首秀:4.5倍提升

9月9日,MLCommons社區發布了最新的MLPerf 2.1基準測試結果,新一輪基準測試擁有近5300個性能結果和2400個功耗測量結果,分別比上一輪提升了1.37倍和1.09倍,MLPerf的適用范圍進一步擴大。

阿里巴巴、華碩、Azure、壁仞科技、戴爾、富士通、技嘉、H3C、HPE、浪潮、Intel、Krai、聯想、Moffett、Nettrix、Neural Magic、NVIDIA、OctoML、高通、SAPEON 和 Supermicro 均是本輪測試的貢獻者。

其中,NVIDIA表現依然亮眼,首次攜H100參加MLPerf測試,並在所有工作負載中刷新世界紀錄。

H100打破世界記錄,較A100性能提升4.5倍

,與兩年前推出的NVIDIA Ampere架構相比,實現了數量級的性能飛躍。

黃仁勛曾在 GTC 2022 上表示,20個H100 GPU便可以承托相當於全球網際網路的流量,能夠幫助客戶推出先進的推薦系統及實時運行數據推理的大型語言模型。

令一眾AI從業者期待的H100原本定於2022年第三季度正式發貨,目前處於接受預定狀態,用戶的真實使用情況和H100的實際性能尚不可知,因此可以通過最新一輪的MLPerf測試得分提前感受H100的性能。

在本輪測試中,對比Intel Sapphire Rapids、Qualcomm Cloud AI 100、Biren BR104、SAPEON X220-enterprise,NVIDIA H100不僅提交了數據中心所有六個神經網絡模型的測試成績,且在單個伺服器和離線場景中均展現出吞吐量和速度方面的領先優勢。

以NVIDIA A100相比,H100在MLPerf模型規模最大且對性能要求最高的模型之一——用於自然語言處理的BERT模型中表現出4.5倍的性能提升,在其他五個模型中也都有1至3倍的性能提升。

H100之所以能夠在BERT模型上表現初出色,主要歸功於其Transformer Engine。

其他同樣提交了成績的產品中,只有Biren BR104在離線場景中的ResNet50和BERT-Large模型下,相比NVIDIA A100有一倍多的性能提升,其他提交成績的產品均未在性能上超越A100。

而在數據中心和邊緣計算類別的場景中,A100 GPU的測試成績依然不俗,得益於NVIDIA...

別再給GPU均勻塗抹矽脂了:溫度不減反增5℃

PC老鳥們,你們是如何給CPU或者GPU頂蓋塗抹矽脂的?

硬體發燒友Igor Wallossek最近的一個發現是,至少就GPU而言,那種看起來非常隨意的“香腸式”塗抹法,也就是簡單地擠成一條線,比點陣法以及均勻塗抹對散熱更奏效。

表中的結果非常直觀,在室溫20~22攝氏度的環境中,對RTX 3080公版卡測試發現,“香腸法”可以比在整個表面均勻塗抹的手法平均降溫5℃。

其實解釋起來並不復雜,因為GPU表面發熱並不均勻,通常是中間部分發熱最多,也容易受熱膨脹。雖然看似裝散熱器前塗抹均勻了,但隨著熱脹冷縮以及散熱器接觸擴散塗抹區域,實際會讓中間部分的矽脂變少,降低散熱效果。

另外,作者還推薦使用Alphacools(阿爾法酷) Apex、Gelid(捷領) PC Extreme、Subzero等幾家的矽脂,不建議名聲更大的Arctic MX-2、Arctic MX-4等。

來源:快科技

AMD下代三大GPU核心靚照公布:瘦成一道閃電

推特博主Wild_C近日又製作了一組AMD下一代三大GPU核心的渲染圖,,畢竟信息更新了。

Navi 31大核心採用一個GCD、六個MCD的小晶片組合,之前傳聞面積分別是369、44平方毫米,合計達633平方毫米,但最新說法變成了308、37.5平方毫米,總計僅為533平方毫米,小了近16%。

規格上,96組計算單元、12288個流處理器沒變,但是(太大了作用不明顯),顯存搭配384-bit 24GB GDDR6顯存,帶寬864GB/,功耗或達450W。

Navi 32中等核心是一個GCD、四個MCD的組合,前者面積之前說是263平方毫米,總面積為439平方毫米,現在變成了350平方毫米,小了超過20%。

規格上,流處理器數量從8192個減少到7680個,無限緩存64MB,顯存配256-bit 16GB GDDR6。

Navi 33小核心則是單晶片設計,面積從之前說的400平方毫米變成了203平方毫米,小了足足一半。

4096個流處理器、128-bit 8GB緩存,都正好是Navi 32的一半。

值得一提的是,Navi 33核心可能只會使用PCIe 5.0 x8的系統總線,這也是AMD小核心的慣例,當然完全不影響性能,還能節省成本。

同樣慣例,Navi 33核心會採用45度傾斜的布局。

來源:快科技

AMD下代GPU核心縮小33% 但多了6個大家

AMD早已官宣將在下半年推出下一代顯卡,基於Navi 3x系列核心,預計命名RX 7000系列。

Navi 3x系列將一改往日的單晶片設計,採用多個小晶片組合,與銳龍、霄龍處理器如出一轍,其中頂級的Navi 31包括一個GCD(Graphics Complex Die),台積電5nm,主要是圖形處理相關單元,搭配六個MCD(Memory Complex Die),台積電6nm,主要是顯存控制器等其他單元。

根據權威曝料高手@Greymon55的說法,Navi 31核心的GCD部分面積為350平方毫米多一點。

這對比RX 6900/6800系列用的Navi 21核心的520平方毫米小了足足33%,但後者是單獨一個核心,因此缺乏直接可比性。

Navi 13 MCD部分的面積暫時不詳,六個加起來也會很可觀,總面積幾乎必然會大於Navi 21,不然也不會分離設計。

假設每個MCD 40平方毫米,那麼總面積將達590平方毫米,幾乎和NVIDIA AD102核心差不多,後者據傳600平方毫米左右。

非等比例對比

不過值得一提的是,Navi 31核心會取消一些非必要的和過時的模塊,比如用於多卡並聯的XGMI總線、GDS(全局數據共享)、幾何流水線、掃描轉換器等等,這也能節省不少電晶體和面積。

另外,Navi 32核心也會是類似的小晶片設計,MCD預計減少到4個,Navi 33則是繼續單晶片。

來源:快科技

龍芯3號處理器晶片組7A2000發布:首次自研GPU 零的突破

據龍芯中科官方消息,與龍芯3號系列處理器配套的橋片(即晶片組)正式發布了,型號為“龍芯7A2000”,不但高速I/O接口達到市場主流水平,還首次集成了自研的GPU核心。

橋片(晶片組)是連接CPU、外圍接口/外設擴展接口的晶片,一側與CPU直接進行數據交換,另一側與硬碟、網絡、顯示等外設進行通訊,決定著I/O傳輸的帶寬、圖形信息的處理能力。

龍芯7A2000橋片可與龍芯3A5000、龍芯3C5000處理器搭檔,提升龍芯平台在桌面、伺服器的整體性能表現。

7A2000橋片首次集成龍芯自研的統一渲染架構GPU模塊,核心頻率400-500MHz,API圖形接口支持OpenGL 2.1、OpenGL ES 2.0。

顯存搭檔DDR4,頻率2.0-2.4GHz,最大容量16GB。GPU模塊搭配獨立顯存,還可形成獨顯方案。

支持雙屏顯示,典型解析度1080p60Hz,最高支持2K30Hz。

性能方面,glmark2可以超過300FPS,glxgears可以超過1800FPS,滿足桌面辦公需求是沒問題的。

功能方面,龍芯7A2000內部集成了PCIe 3.0、SATA 3.0、USB 3.0/2.0、千兆網PHY、HDMI、I2C、UART、GPIO等接口,可為龍芯處理器提供豐富的南北橋功能。

其中,顯示接口升級為雙路HDMI、一路VGA,可直連顯示器,而內置的網絡PHY物理層,可直接提供網口輸出。

配合龍芯7A2000,龍芯3A5000處理器的讀寫性能、傳輸速度也再次顯著提升:

- HyperTransport總線頻率達到3.2GHz,DDR4記憶體頻率達到2400MHz

- 與上代龍芯7A1000對比,SATA讀取性能提升82%,寫入性能提升97%

- 與上代龍芯7A1000對比,PCIe性能提升1.4倍

目前,多家板卡、ODM廠商已經就龍芯3A5000+7A2000、龍芯3C5000/3C5000L+7A2000,進行單路、雙路、四路的開發,各類硬體產品將應用於政務辦公、金融、網安、教育、通信、工控、交通、醫療等領域,以及數據中心、雲計算中心。

在龍芯3A5000+7A2000電腦上進行拷貝測試

來源:快科技

自研GPU看齊GTX1050 景嘉微JM9系列第二款圖形晶片完成初測等

景嘉微今天(6月28日)給出消息稱,公司的JM9系列第二款圖形處理晶片已完成初步測試等工作。

據景嘉微公告,公司JM9系列第二款圖形處理晶片已完成流片、封裝階段工作及初步測試工作;根據公司測試結果,該圖形處理晶片滿足地理信息系統、媒體處理、CAD 輔助設計、遊戲、虛擬化等高性能顯示需求和人工智慧計算需求。

此前報導,2021年12月10日,景嘉微發布了GPU旗艦新品JH920,JH920採用14nm工藝,關鍵指標上,該晶片像素填充率為32G Pixels/,單精度浮點性能為1.5TFlops,功耗為30W。

與之可比的是NVIDIA的GeForce GTX 1050,該GPU同樣採用14nm工藝,像素填充率為36.43G Pixels/,浮點性能為1.733TFlops,功耗為75W。

按照景嘉微的說法,2021年公司晶片領域產品實現收入4.47億元,同比增長517.46%,為公司未來在通用市場的長遠發展創下了良好開端。

圖形顯控領域產品方面,景嘉微成功研發了具有完全自主智慧財產權的系列GPU晶片,並以公司自主研發的GPU晶片為核心開發了系列圖形顯控模塊產品,顯著提升了公司產品競爭力。

來源:快科技

85萬核心的世界最大AI晶片打破記錄:要”殺死” GPU

以造出世界上最大加速器晶片CS-2 Wafer Scale Engine聞名的公司Cerebras宣布,他們已經在利用「巨芯」進行人工智慧訓練上走出了重要的一步,訓練出了單晶片上全世界最大的NLP(自然語言處理)AI模型。

該模型具有20億個參數,基於CS-2晶片進行訓練。

這塊全世界最大的加速器晶片採用7nm製程工藝,由一整塊方形的晶圓刻蝕而成。

它的大小數百倍於主流晶片,具有15KW的功率,集成了2.6萬億個7nm電晶體,封裝了850000個內核和40GB記憶體。

圖1 CS-2 Wafer Scale Engine晶片

單晶片訓練AI大模型新紀錄

NLP模型的開發是人工智慧中的一個重要領域。利用NLP模型,人工智慧可以「理解」文字含義,並進行相應的動作。OpenAI的DALL.E模型就是一個典型的NLP模型。這個模型可以將使用者的輸入的文字信息轉化為圖片輸出。

比如當使用者輸入「牛油果形狀的扶手椅」後,AI就會自動生成若干與這句話對應的圖像。

圖:AI接收信息後生成的「牛油果形狀扶手椅」圖片

不止於此,該模型還能夠使AI理解物種、幾何、歷史時代等復雜的知識。

但要實現這一切並不容易,NLP模型的傳統開發具有極高的算力成本和技術門檻。

實際上,如果只討論數字,Cerebras開發的這一模型20億的參數量在同行的襯托下,顯得有些平平無奇。

前面提到的DALL.E模型具有120億個參數,而目前最大的模型是DeepMind於去年年底推出的Gopher,具有2800億個參數。

但除去驚人的數字外,Cerebras開發的NLP還有一個巨大的突破:它降低了NLP模型的開發難度。

「巨芯」如何打敗GPU?

按照傳統流程,開發NLP模型需要開發者將巨大的NLP模型切分若干個功能部分,並將他們的工作負載分散到成百上千個圖形處理單元上。

數以千百計的圖形處理單元對廠商來說意味著巨大的成本。

技術上的困難也同樣使廠商們痛苦不堪。

切分模型是一個定製的問題,每個神經網絡、每個GPU的規格、以及將他們連接(或互聯)在一起的網絡都是獨一無二的,並且不能跨系統移植。

廠商必須在第一次訓練前將這些因素統統考慮清楚。

這項工作極其復雜,有時候甚至需要幾個月的時間才能完成。

Cerebras表示,這是NLP模型訓練中「最痛苦的方面之一」,只有極少數公司擁有開發NLP所必要的資源和專業知識。對於人工智慧行業中的其他公司而言,NLP的訓練則太昂貴、太耗時且無法使用。

但如果單個晶片就能夠支持20億個參數的模型,就意味著不需要使用海量的GPU分散訓練模型的工作量。這可以為廠商節省數千個GPU的訓練成本和相關的硬體、擴展要求,同時這也使廠商不必經歷切分模型並將其工作負載分配給數千個GPU的痛苦。

Cerebras也並未僅僅執拗於數字,評價一個模型的好壞,參數的數量並不是唯一標準。

比起希望誕生於「巨芯」上的模型「努力」,Cerebras更希望的是模型「聰明」。

之所以Cerebras能夠在參數量上取得爆炸式增長,是因為利用了權重流技術。這項技術可以將計算和記憶體的占用量解耦,並允許將記憶體擴展到足以存儲AI工作負載中增加的任何數量的參數。

由於這項突破,設置模型的時間從幾個月減少到了幾分鍾,並且開發者在GPT-J和GPT-Neo等型號之間「只需幾次按鍵」就可以完成切換。這讓NLP的開發變得更加簡單。

這使得NLP領域出現了新的變化。

正如Intersect360 Research 首席研究官 Dan Olds 對Cerebras取得成就的評價:「Cerebras 能夠以具有成本效益、易於訪問的方式將大型語言模型帶給大眾,這為人工智慧開辟了一個激動人心的新時代。」

來源:快科技

EA將《FIFA 22》加入EA Play服務 XGPU用戶也可遊玩

EA宣布《FIFA 22》即將於6月23日加入EA Play服務,會員可享受更多遊戲福利,包括《FIFA 22》中定期的會員專屬獎勵,例如VOLTA服裝和金幣、Ultimate Team賽季經驗值提升和球場套裝。

由於XGPU包含EA Play服務,所以這意味著XGPU的用戶也可以遊玩《FIFA 22》。

來源:遊俠網

《FIFA 22》即將加入EA Play服務 XGPU用戶可玩

EA宣布《FIFA 22》即將於6月23日加入EA Play服務,會員可享受更多遊戲福利,包括《FIFA 22》中定期的會員專屬獎勵,例如VOLTA服裝和金幣、Ultimate Team賽季經驗值提升和球場套裝。

由於XGPU包含EA Play服務,所以這意味著XGPU的用戶也可以遊玩《FIFA 22》。

來源:3DMGAME

XGPU功能拓展:將支持Demo和串流遊玩已購買過的遊戲

微軟宣布他們將擴展Xbox Game Pass Ultimate所提供的內容,這包括遊戲Demo以及通過雲串流遊玩用戶已經購買的遊戲,這包括用戶已經擁有的部分遊戲或是在Xbox Game Pass遊戲庫之外購買的遊戲。

Xbox遊戲體驗兼平台副總裁Ashley McKissick解釋說:「玩家告訴我們的其中一個事情是他們想串流他們所擁有的遊戲,甚至這些遊戲並不在Game Pass遊戲庫中。所以今年晚些時候,如果你是Game Pass Ultimate會員,你將能夠從你購買的雲遊戲和你已經擁有的遊戲中串流,只要它們在目錄中是支持雲的。」

微軟還公布了Project Moorcroft項目,Xbox Game Pass會員可以遊玩即將發售遊戲的Demo。該項目將在明年推出,一開始會專注於為全世界的獨立開發者提供更多的機會為他們的遊戲打造興奮點。

參與的開發者將能看到他們的Demo表現如何並獲得補償。

微軟Sarah Bond解釋說:「這就像你以前去E3,去PAX,你會參觀一些你最喜歡的開發者,他們會給你提供一個遊戲的關卡,讓你坐在那里遊玩。工作室的人就在你旁邊......你可以體驗遊戲,他們可以讓他們正在打造的東西和即將到來的東西產生興奮。

但這些機會越來越小,越來越難以復制。

所以我們說,"為什麼我們不把Game Pass變成一個展示廳?我們為什麼不讓開發者把他們遊戲的一部分發布到Game Pass中呢,為即將到來的遊戲預熱,並在他們調整和准備發售他們的遊戲時獲得真正有價值的反饋?"

最後,微軟表示他們將在世界各地新增「數千個」定製Xbox Series X機架,使其雲遊戲容量增加125%。

來源:遊俠網

涉嫌GPU專利侵權 「小螃蟹」瑞昱被AMD告了

AMD最近突然在專利官司上發難,在美國ITC國際貿易委員會上起訴了多家公司,其中就包括「小螃蟹」瑞昱電子,理由是他們的晶片中包含了未授權的AMD圖形專利。

日前有報導稱,AMD和ATI於5月5日對TCL電子、瑞昱半導體等據美國關稅法的「337條款」發起投訴,指控TCL、瑞昱等被告銷售到美國境內的圖形系統及其組件和包含該系統的數位電視侵犯了AMD持有的5項美國專利。

AMD訴請美國國際貿易委員會在60天的調查期內對被指控的侵權產品發出政令禁止其進口到美國,並徵收保證金。

對於起訴,瑞昱電子方面回應稱,對公司營運無影響。

據悉,AMD發起的訴訟仍處於未立案階段,而且電視SoC占瑞昱整體營收比重小,預計今年電視SoC的營收比重僅為9%,低於前年的13%,且瑞昱擁有多家電視客戶,TCL並不是最大的一家,預估影響有限。

來源:快科技