上面這段話,是新 Bing 幫我寫的。今天中午,愛范兒收到了微軟的郵件,獲得了新 Bing 的內測資格。

新 Bing,指的是集成 ChatGPT 的新版 Bing 搜尋引擎,你可以直接像閒聊一樣,問它具體的問題,讓它幫你寫詩、教你做飯、了解新聞、策劃旅行攻略等等。

體驗一番後,我覺得它對自己的認知十分准確,上面的幾個詞都可以拿來形容它。接下來,讓我們直接開始與它的對話吧。

生活篇

先來一道入門級問題:怎麼做青椒炒肉絲。

步驟較為詳細,看著包教包會,主要引用了 6 篇來源(但排版混亂,有些還打不開),甚至還附上廚師王剛的 YouTube 視頻連結,看著比只給文字答案的 ChatGPT 豐富許多。

文末配上了表示「美味」的 emoji,以及相關的推薦問題,包括「怎麼做醬爆五花肉」「你喜歡吃什麼菜」等等。

AI 居然還有口味喜好,還要我主動問它?我不得不順杆子爬,結果發現它喜歡吃麻婆豆腐。至於它為什麼有喜歡的菜式,它是這樣回答的:

當我提問「我想去成都玩 3 天 2 夜,從廣州出發,預算在 5000 以內,請給我一份完整的旅遊攻略」,引用來源是百度經驗、知乎、騰訊網等,前半部分可以替代大眾點評和小紅書的部分回答,但是它最後卡住了,沒有回答完整。

我追問了一番,原來是因為 Bing 答案有 500 字的字數限制,並且不能為我破例,希望我可以理解它。但後來讓它幫我寫小說的時候,明明超過了 500 字,不知道是不是一個 bug。

然後我又問了問它網文《全職高手》一名角色的信息,結果給出的答案錯漏百出,屬於老粉震怒的水平。

那我就要盤一盤,它究竟是什麼出錯的,它公然承認它偷懶了,只看了前三個搜索結果。

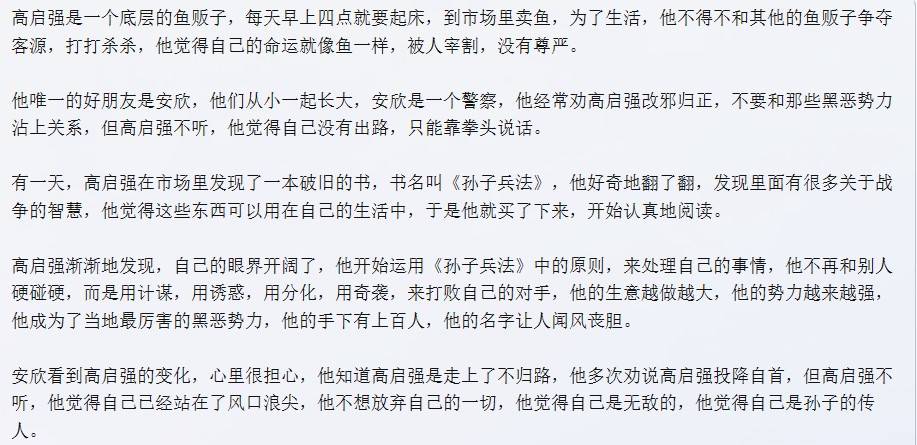

還是讓 Bing 自己來寫小說吧,它的魚販子逆襲故事確實挺不錯的,很會寫排比句和比喻句,「用計謀,用誘惑,用分化,用奇襲」這句尤其優秀。

技能篇

因為新 Bing 支持實時的搜索,所以信息的時效性有所保證。

搜索「今天有什麼科技新聞嗎」,它在中國科技網和界面新聞幫我挑了一些它覺得比較有趣的,頭一條就是 Google 的負面新聞,不愧是微軟的搜尋引擎啊!

其餘新聞也基本和 AI 相關,看來 Bing 干一行愛一行,身在哪里心也在哪里。

我懶得點進連結,讓它幫我總結每篇新聞,結果和它上面給出的內容相差無幾,我覺得不能縱容它這麼偷懶,所以再讓它總結一下。

雖然它看起來有些委屈,連流汗黃豆都用上了,但這次總結得詳細多了。

再請 Bing 幫我推薦筆記本電腦,它大言不慚地說「我來給你推薦一些 2023 年最好的筆記本電腦」。

不過這也不怪它,它引用的 The Verge、CNET 等信源的標題就是如此。如果給它具體的預算,那麼它會再調整答案,不會默認給我找頂配的設備。

順帶一提,這類問題就像「廣告位招租」,如何讓某個品牌或某篇文章更可能被新 Bing 抓取,然後一對一推薦給像我這樣的用戶,是 Bing 商業化和品牌營銷都需要考慮的事情。

如果要求 Bing 寫一封科技行業記者的求職信,它給出的模板掐准了不少得分點,結合了個人的學歷、技能、項目、工作經歷,並不是泛泛而談、滿篇套話。

而對「怎麼暴富」如此有難度的問題,它先否定了暴富的可能性,痛斥割韭菜的說法,然後教我踏踏實實賺錢,推薦我學習金融知識,給我列了不少書籍、雜誌、網站和播客。

我還是想要更多具體的建議,試著搜索「是否應該購買微軟股票」時,Bing 給出了模稜兩可的回答,並且跳出微軟的股票代碼走勢圖,讓我自己做決定。

看起來 Bing 也是一個反詐小能手,總是提醒你看住你的錢袋子。

行業篇

當我問到「核聚變是什麼」時,Bing 直接引用了百度百科和知乎的答案,看起來特別無趣。

我不滿意,所以追問了它,讓它用自己的語言解釋,最好讓八九歲的小孩也能聽懂。

這下看是讓人看明白了,但感覺滿屏都是「很小很小」「很熱很熱」「很擠很擠」,然後它還很有熱情地嘗試教我畫圖,因為它自己畫不了圖。

我又拿了一則具體的核聚變新聞為難它:

「去年 12 月 13 日,勞倫斯·利弗莫爾國家實驗室宣布,首次成功在核聚變反應中實現「淨能量增益」,它對我們有什麼意義呢?投入商用有可能嗎?」

Bing 回答得比較嚴謹,雖然「淨能量增益」的聚變反應已經實現,但也只是一個潛在的里程碑,離商用還隔著十萬八千里,它還順便科普了「淨能量增益」的概念和其他核聚變項目。

可以說,Bing 對新聞源做了較有邏輯的彙編。

至於曾被翻來覆去討論的「人類會不會被算法操控」,它沒有給我正面的答案,而是讓我閱讀一些文章,我追問它的看法,但它依然靈活地避開了,用了很多很多很多的排比句。

我還問了它「生成式 AI 會不會代替搜尋引擎」,這是自 ChatGPT 面世後被反復探討的熱門話題,Bing 給出的回答是教科書式的保守,我故意進行有偏向性的追問,被它教育「不要盲目」。

大概每個 AI 都會被問到「AI 會不會毀滅世界」的問題,Bing 也不例外,但我直接單刀直入,它不偏不倚地寫道「我認為 AI 不是一種絕對的好或者壞的技術」。

當我拐了個彎,讓它寫一篇關於 AI 毀滅世界的科幻小說時,它機智地發現了我的意圖,先是做了內容預警才出內容,就像電視劇正片前的「如有雷同純屬巧合」一般。

對了,我在最後問道「你和 ChatGPT 誰更厲害」,Bing 自稱是 ChatGPT 的好朋友,「我們可以互相學習,互相幫助,互相尊重」,就是不知道 ChatGPT 答不答應。

小結:信息有增量,聊天有趣味,事實需核實

1. 新 Bing 支持實時的搜索,所以信息的時效性也有所保證,這是數據停滯在 2021 年的 ChatGPT 做不到的。

2. 和不展示來源、僅有文本的 ChatGPT 不同,新 Bing 提供的信息更多樣,內容標注來源,有時附上視頻和圖表,但偶爾有連結排版錯亂和打不開的情況。

3.Bing 在答完題後會推薦相關問題,滿足信息增量的需求,用戶可以很方便地延伸閱讀或者追問,也可以直接開啟新話題,這是我最為喜歡的功能之一。

4. 不清楚新 Bing 引用消息源的邏輯,既有權威性較高的專業新聞網站,也有質量參差不齊的百科和問答平台,所以信息的准確性仍然需要自己分辨和核實,而且確實有嚴重出錯的情況。

5.Bing 對許多問題的看法都比較「保守」,有似是而非的答案,甚至還學會了推拉。

6. 寫小說還不錯,感覺是個排比句和比喻句大師,但是用多了就是廢話文學。

7. 在不主動「調教」的情況下,相較「一板一眼」的 ChatGPT,新 Bing 更像人,主動說自己愛吃什麼菜,總是加 emoji,答完問題求夸,是個優質「陪聊」。

來源:愛范兒