Tag: Cerebras

Cerebras發布WSE-3:採用5nm工藝,4萬億個電晶體,90萬個AI核心

Cerebras宣布,推出Wafer Scale Engine 3(WSE-3),這是世界上尺寸最大的單顆裸片,幾乎等於一塊12英寸晶圓。其專為訓練業界最大的AI模型而打造,在相同的功耗和價格下,性能是現有最快AI晶片WSE-2的兩倍。WSE-3將用於Cerebras CS-3 AI超級計算機,通過2048個節點提供高達256 exaFLOPs的計算性能。

WSE-3的主要規格:

4萬億個電晶體

900,000個AI核心

44GB的片上SRAM緩存

台積電5nm工藝製造

可選1.5TB / 12TB / 1.2PB三種內存容量

125 petaflops的峰值AI算力

可訓練多達24萬億個參數的人工智慧模型

可達2048個CS-3系統的集群規模

Cerebras表示,WSE-3專為滿足企業和超大規模需求而構建,旨在訓練比GPT-4和Gemini大10倍的下一代前沿模型,24萬億個參數模型可以存儲在單個邏輯內存空間中,無需分區或重構,從而大大簡化了訓練工作流程,提高了開發人員的工作效率。

最新的Cerebras軟體框架為PyTorch 2.0和最新的AI模型和技術提供原生支持,比如多模態模型、視覺轉換器、專家混合和擴散等,仍然是唯一一個為動態和非結構化稀疏性提供原生硬體加速的平台,可以將訓練速度提高8倍。 ...

Cerebras推出Andromeda:擁有1350萬核心的AI超級計算機

Cerebras宣布,推出Andromeda,這是一款擁有1350萬核心的AI超級計算機,部署於美國加利福尼亞州聖克拉拉的數據中心,現已用於商業和學術工作。其採用了16個Cerebras CS-2系統集群構建,並利用Cerebras MemoryX和SwarmX技術簡化和協調跨系統的模型拆分,以16位半精度提供超過1 Exaflop的AI計算和120 Petaflops的密集計算。

Cerebras稱,Andromeda基於AMD第三代EPYC伺服器處理器,以及Cerebras的Wafer Scale Engine 2構建,是唯一一台僅依靠簡單數據並行性在大型語言模型工作負載上展示近乎完美的線性擴展的AI超級計算機,在GPT類大型語言模型里幾乎呈線性擴展,這效率是標準GPU集群所無法比擬的。

Wafer Scale Engine 2是世界上尺寸最大的單顆裸片,面積為462.25平方厘米,幾乎等於一塊12英寸晶圓。其擁有850000個AI內核,2.6萬億個電晶體,配備了40GB的SRAM,提供了20 PB/s緩存帶寬和220 Pb/s互聯帶寬,採用台積電7nm工藝製造。這些晶片將分布在16個機架的124個伺服器節點上,通過100 GbE網絡連接,並由284個AMD第三代EPYC伺服器處理器提供支持,均為64核心128線程規格,總有18176個核心。

Andromeda整個系統的功耗為500KW,比採用GPU加速的超級計算機的功耗要低得多。這樣的設計並不是完美無缺,在這種大規模並行的超級計算機上擴展工作負載長期以來都是制約其發展的因素之一,某些情況下擴展很容易會崩潰,因此添加更多硬體會導致回報迅速減少。 ...

Cerebras發布世界尺寸最大晶片,擁有2.6萬億個電晶體

近日,Cerebras宣布推出Wafer Scale Engine 2,其面積為462.25平方厘米,是世界上尺寸最大的單顆裸片,幾乎等於一塊12英寸晶圓。在2019年8月份,第一代Wafer Scale Engine就因其iPad般大小的面積引起了不少人的關注。

相比初代產品,Wafer Scale Engine 2在面積上相若,不過擁有850000個AI內核,是原來的400000個的兩倍有餘,當然電晶體數量也是,1.2萬億個增加到2.6萬億個。為了在相同體積容納更多電晶體,其製造工藝也從原來的台積電的16nm,升級到7nm,在功耗方面也保持一致,為15kW。另外晶片上還有40 GB的 SRAM,提供20 PB/s緩存帶寬和220 Pb/s互聯帶寬,基本上所有參數規格都比上一代產品增加了一倍有餘。

這間來自加州矽谷的晶片初創公司Cerebras Systems在推出第一代產品後,與美國能源部屬下阿貢國家實驗室合作,打造了基於Wafer Scale Engine晶片的AI計算系統CS-1,目前已經擁有多個客戶,包括包括美國匹茲堡超級計算機中心的AI超級計算機「Neocortex」。

來源:超能網

Cerebras將7nm製程引入到其晶圓級晶片,現可擁有2.6萬億電晶體、85萬個核心

Cerebras Systems去年的這個時候發布了一款晶圓級深度學習晶片Cerebras WSE(Wafer Scale Engine),尺寸達到了215×215平方毫米。幾乎占據了一整個晶圓的大小。這整個晶片擁有1.2萬億電晶體,40萬個核心,晶片尺寸達到了46225平方毫米,比當前最大的GPU核心要大56倍,現在Cerebras繼續在刷新著記錄。

在今年的Hot Chips大會上,Cerebras表示現在可以實現整個晶片擁有2.6萬億電晶體,85萬個核心,相比之前的規格增加了一倍有餘。然而實現方式其實很「簡單」,因為去年的那款晶片還是採用的台積電16nm工藝進行製造,現在只需換成台積電最新的7nm製程工藝,就可以實現如此壯舉。該公司表示,它已經在實驗室中運行了新款晶片。

當然,這第二代的新款晶圓級晶片仍將具有與第一代相同的晶片面積,畢竟,它受到晶圓尺寸的限制。此外,預計該公司還將增加晶片內置的記憶體容量並加強晶片互連速率,以提高晶片內數據傳輸的帶寬。去年的第一代晶片具有9PB/s的記憶體帶寬,並且這樣一個晶片的TDP為15KW。

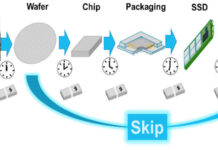

晶圓級晶片除了像Cerebras這樣製作計算晶片的應用外,也有應用於存儲方面的研究。鎧俠(前東芝存儲)正在進行的新研究就是——通過跳過傳統快閃記憶體和SSD製造方法過程中所有切割,組裝,封裝等操作,直接生產晶圓級的SSD ,這樣可以極大地降低製造成本和交貨時間,並且得到高性能的大量數據存儲解決方案。

不過雖然鎧俠提出了「晶圓級固態硬碟」的概念,但是還處在早期開發階段,距離實際上市和應用還很早。目前受矚目的晶圓級晶片還是Cerebras WSE,而關於第二代Cerebras WSE的更多信息,還是得到該公司宣布最終產品時才能知道。 ...

鎧俠正在研究晶圓級固態硬碟,可達到數百萬IOPS的性能

目前傳統的SSD生產過程是將一片整個的晶圓進行切片,然後封裝,這樣才得到我們常見到的快閃記憶體顆粒與主控晶片,將他們整合在一塊PCB板上就是目前我們見到的SSD。作為生產過程,這些中間的每一步都需要花錢,於是在最近的「 2020年技術與電路研討會(VLSI 2020年研討會)」上,鎧俠(前東芝存儲器)的首席工程師大島茂雄提出了他們團隊正在進行的新的研究——跳過中間步驟,將一整片晶圓直接變成可用的SSD。

據mynavi報導,鎧俠在其內部引入了稱為「晶圓級固態硬碟」的技術概念。通過跳過傳統快閃記憶體和SSD製造方法過程中所有切割,組裝,封裝等操作,直接生產晶圓級的SSD ,這樣可以極大地降低製造成本和交貨時間,並且得到高性能的大量數據存儲解決方案。該技術概念旨在利用「超級多探測技術」,探測和並行操作單個晶片中的數百個晶片。在超級計算機中堆疊和安裝這種具有超級多探測技術的晶圓級固態硬碟將實現數百萬IOPS的巨大性能。

這種晶圓級的晶片在去年其實已經有出現,就是Cerebras Systems推出的晶圓級深度學習晶片,其晶片面積達到46225平方毫米,如果你對這個數據沒有概念的話,作為對比,CPU中的核心裸片大小一般在200平方毫米以下,而GPU核心的大小也沒有超過1000平方毫米的。官方稱這片晶片的尺寸比當時最大的GPU核心要大56倍,整個晶片擁有1.2萬億電晶體。

目前雖然鎧俠提出了「晶圓級固態硬碟」的概念,但是還處在早期開發階段,距離實際上市和應用還很早。並且,即使實際應用,最初也是用在商業領域,比如需要大量數據存儲的伺服器等。 ...